关键洞察

TPU的十年征程揭示了一个残酷真相:在AI算力军备竞赛中,成本控制可能比性能突破更重大。当技术红利期结束,商业效率将成为终极裁判

一场被迫的自救

2013年,谷歌首席科学家Jeff Dean算了一笔账:如果全球1亿安卓用户每天使用3分钟语音转文字,谷歌需要把数据中心容量翻倍才能支撑。更可怕的是,这个数字还在指数级增长。传统GPU的”冯·诺依曼瓶颈”让矩阵运算效率低下,而通用芯片的冗余设计就像用卡车运快递——能装,但太贵。

谷歌数据中心服务器机房

极简主义的胜利

TPU的设计哲学可以用三个字概括:做减法。它砍掉了GPU中用于图形处理的纹理单元、光栅化引擎,甚至大幅精简了缓存系统。取而代之的是革命性的”脉动阵列”架构——数据像血液流过心脏一样在芯片中循环,计算单元与内存的距离被压缩到极致。这种设计让TPU v7的每瓦性能达到GPU的3倍,训练成本直接腰斩。

全栈控制的降维打击

当英伟达还在卖芯片时,谷歌已经把TPU做成了”芯片+系统+软件”的三位一体。从RTL设计到液冷系统,从XLA编译器到数据中心选址,谷歌掌控了每个可能影响成本的环节。这种垂直整合带来的成本优势有多夸张?有客户实测发现,用TPU v5e Pod训练模型的成本,最低能降到H100方案的1/5,而且随着旧代TPU降价,这个差距还在扩大。

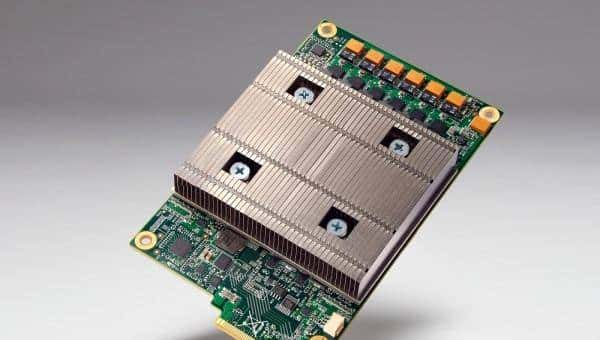

谷歌TPU芯片

生态的阳谋

2017年,谷歌做了个看似”亏本”的决定:免费开放1000台Cloud TPU。这个举动让TensorFlow框架迅速占领开发者心智,更巧妙的是,它把TPU的优化逻辑写进了XLA编译器——当开发者用JAX写代码时,底层自动适配TPU架构。这种”用软件定义硬件”的策略,让TPU在AI框架战争中占尽先机。

市场格局的转折点

2025年,当Gemini 3用TPU v7完成训练时,市场终于意识到:谷歌不是在造芯片,而是在重构游戏规则。摩根士丹利预测,到2027年TPU外销量将达100万颗,这个数字背后是Meta、苹果等巨头的批量采购。更致命的是,TPU正在从训练芯片向推理芯片转型——当AI进入应用爆发期,能效比将决定生死。

写在最后

TPU的成功不仅是技术突破,而是商业智慧的胜利。它证明了在AI时代,”专用”可能比”通用”更有生命力,垂直整合可能比开放生态更有成本优势。当英伟达还在用CUDA构建护城河时,谷歌已经用TPU挖通了另一条河道。这场芯片战争的终局,或许比我们想象的来得更快。

风险提示:以上内容仅供参考,不构成投资提议,股市有风险,入市需谨慎

相关文章