如何本地部署大模型达到和官网能联网搜索的效果,这就不得不提到一个开源神器searXNG。

一、安装Docker

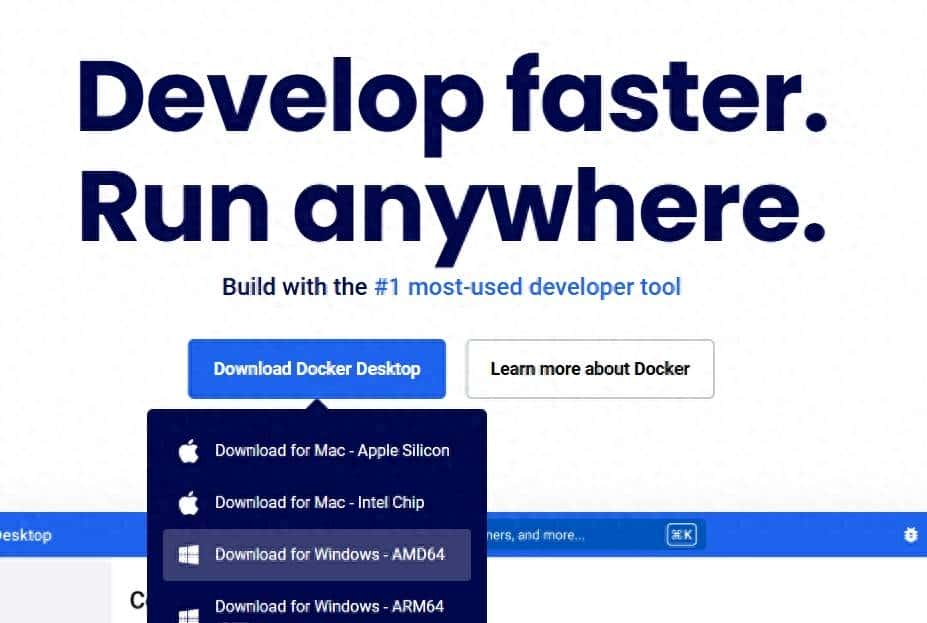

1、官网下载docker,官网www.docker.com,下载完成安装。

docker官网下载

2、docker部署

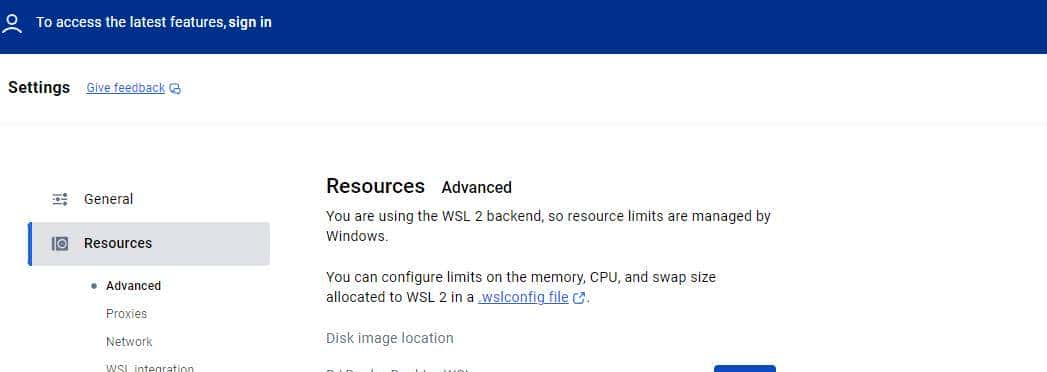

打开docker,右上角点击跳过或建立用户名。更改docker系统目录,默认在C盘,后期会占用很大空间,提议更改到其它盘符。

更改docker部署目录

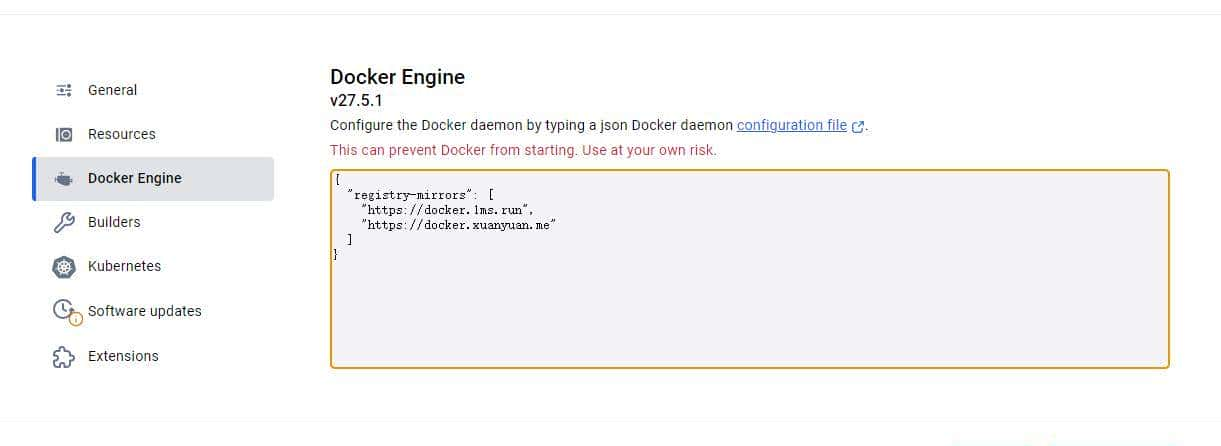

更换镜像源:镜像源地址:

https://docker.xuanyuan.me/

按照此格式进行填写

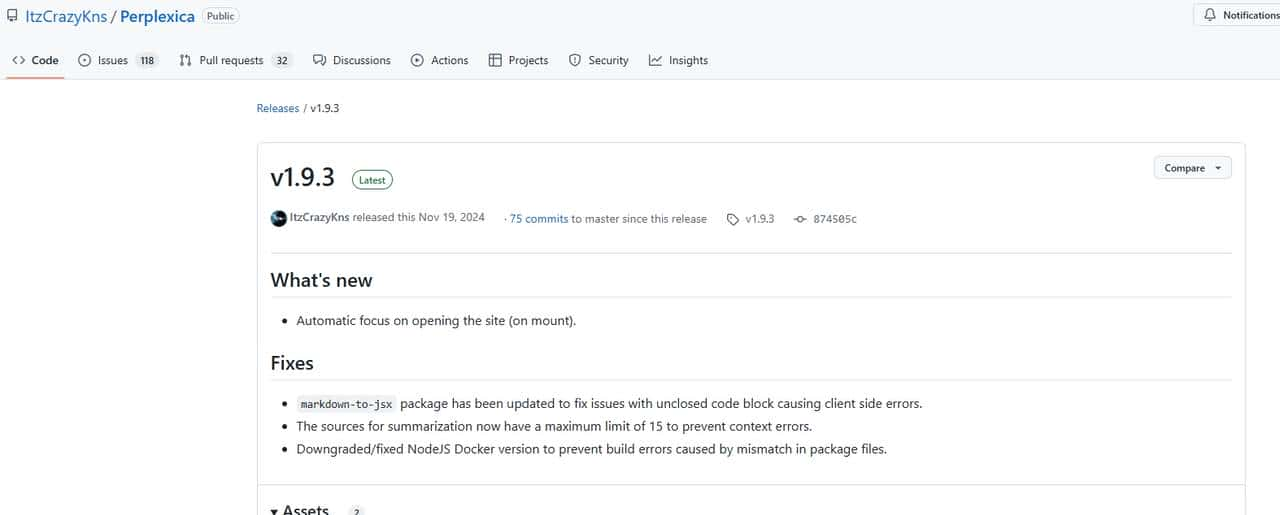

二、github搜索Perplexica,下载解压至本地。需用加速软件 推荐用瓦特。

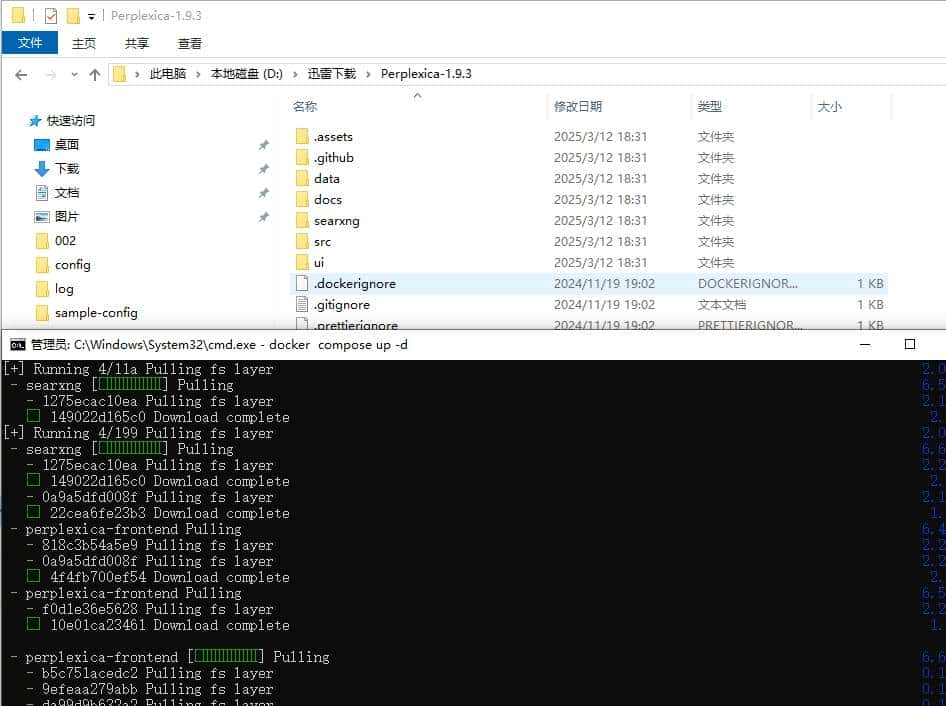

解压后,在目录中找到sample.config.toml文件,修改此文件为config.toml。在Perplexica文件夹中打开powershell窗口(可直接在文件夹地址上输入CMD回车运行) 运行 docker compose up -d 安装。

下载

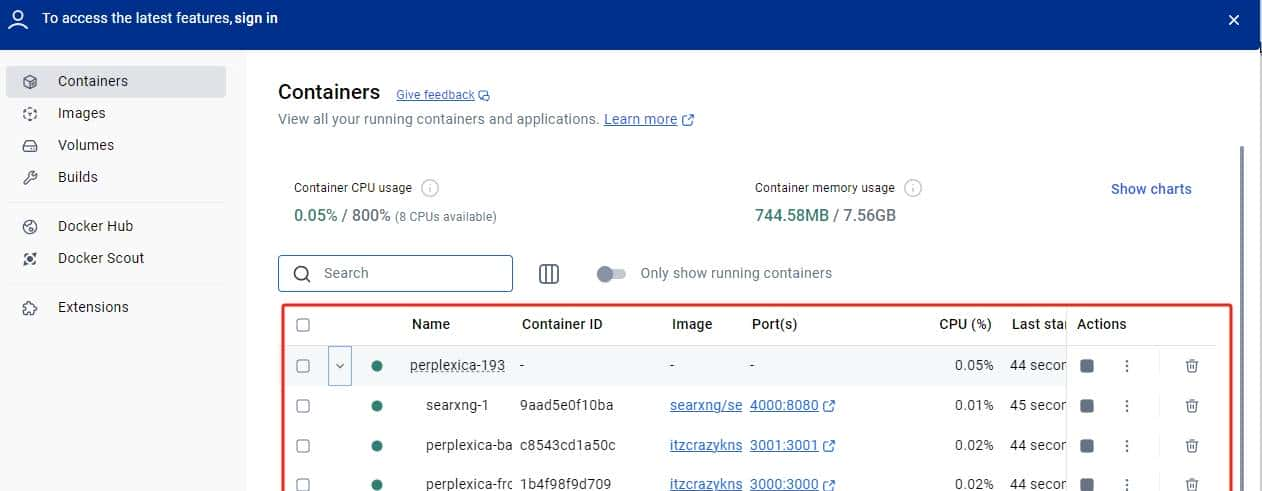

下载完成后,在docker中会出现Perplexica ,点开会出现三个连接地址。

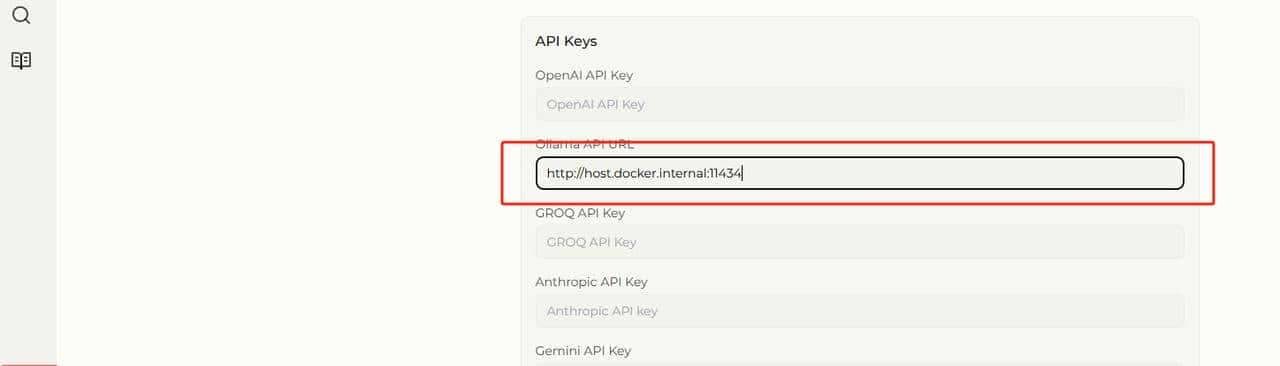

CMD打开Ollama,输入ollama serve进入启动服务。点开如下图链接。

进入网页,右下角点开设置,填写ollama api地址:

http://host.docker.internal:11434

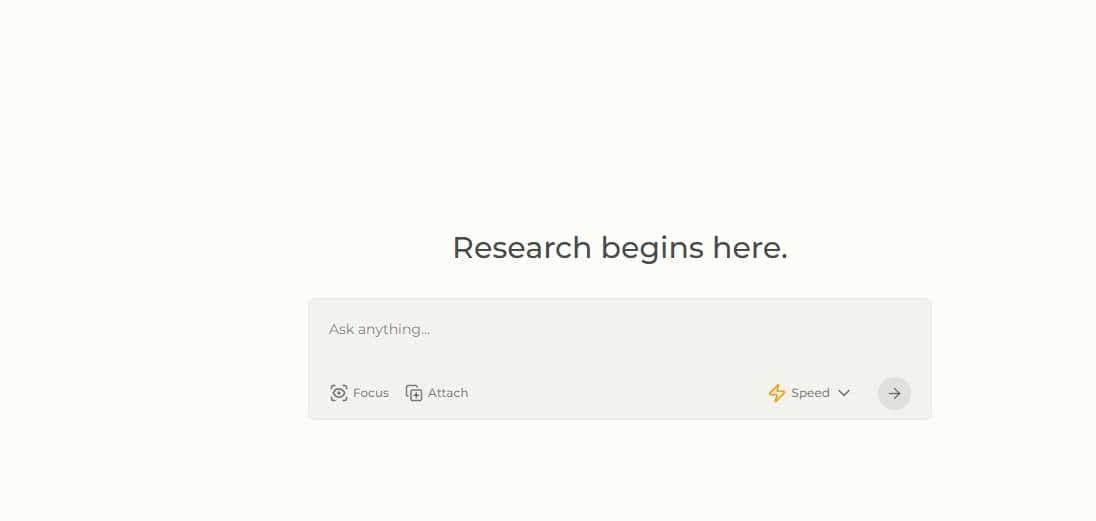

保存 刷新出现如下界面。

到此联网部署设置完成。

三、在Docker中可部署RAGFlow和DIFY 实现本地知识库和构建智能体,具体不在阐述,可咨询deepseek。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

收藏了,感谢分享