将apifox里面的提取到的参数传递到python脚本里面去执行,python对数据进行处理后返回,再对返回的字符串数据进行json处理,供用后续的脚本使用

一.步骤分解:

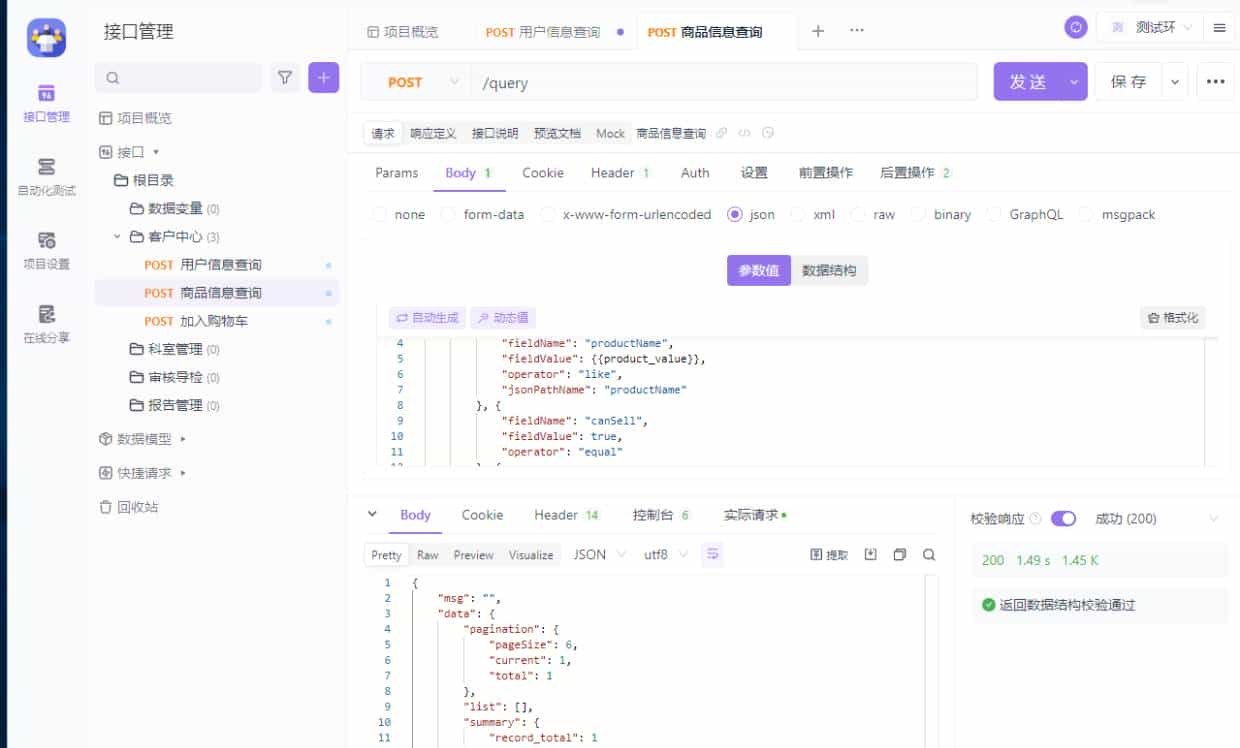

1.商品信息查询

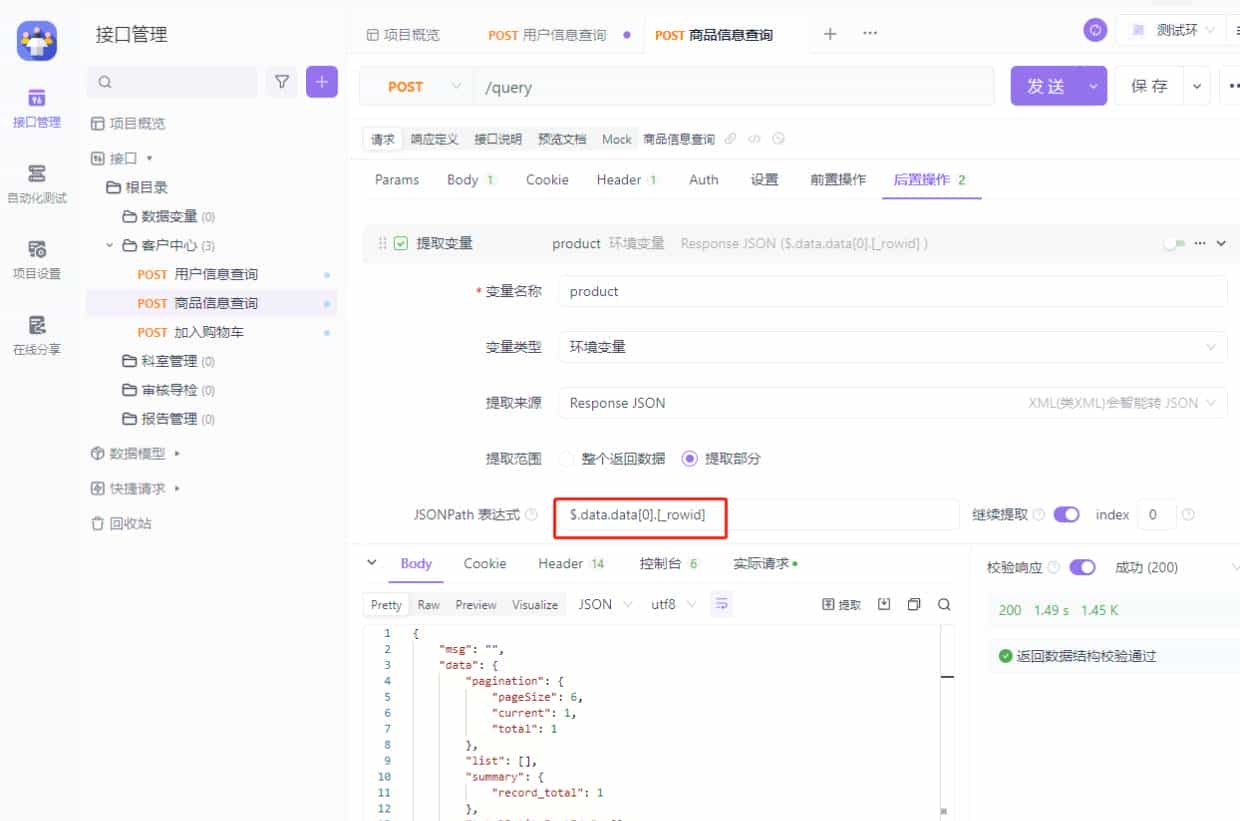

2.后置脚本进行产品信息提取,提取结果在product里

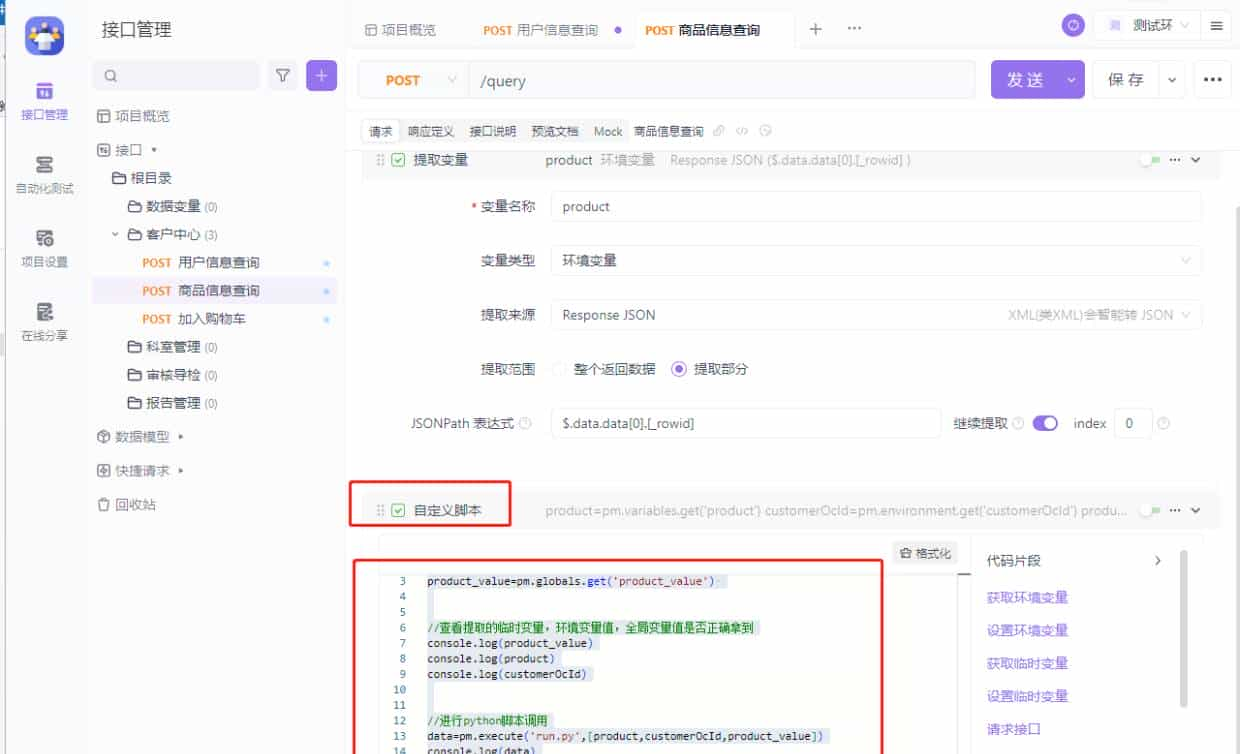

3.自定义脚本将提取到的变量值product放入python脚本

4.python对数据进行处理完毕,包装在字典中,以字符串的形式返回

5.apifox对获取的字符串转成json格式

6.将json数据进行提取,并设置为全局变量,供用后续的接口脚本使用

二.上代码

1.apifox发起请求,获得响应,Header值是全局变量自动默认的(具体实现方式参考上个文档)

2.添加后置变量,提取需要的_rowid

表达式:$.data.data[0].[_rowid],将提取的变量赋予名称product

3.自定义脚本的编写

根据步骤2提取的临时临时变量,之前设置的环境变量,全局变量,进行提取查看

在后置操作添加一个自定义脚本

自定义脚本代码如下

//获取变量

product=pm.variables.get( product )

customerOcId=pm.environment.get( customerOcId )

product_value=pm.globals.get( product_value )

//查看提取的临时变量,环境变量值,全局变量值是否正确拿到

console.log(product_value)

console.log(product)

console.log(customerOcId)

//进行python脚本调用

data=pm.execute( run.py ,[product,customerOcId,product_value])

console.log(data)

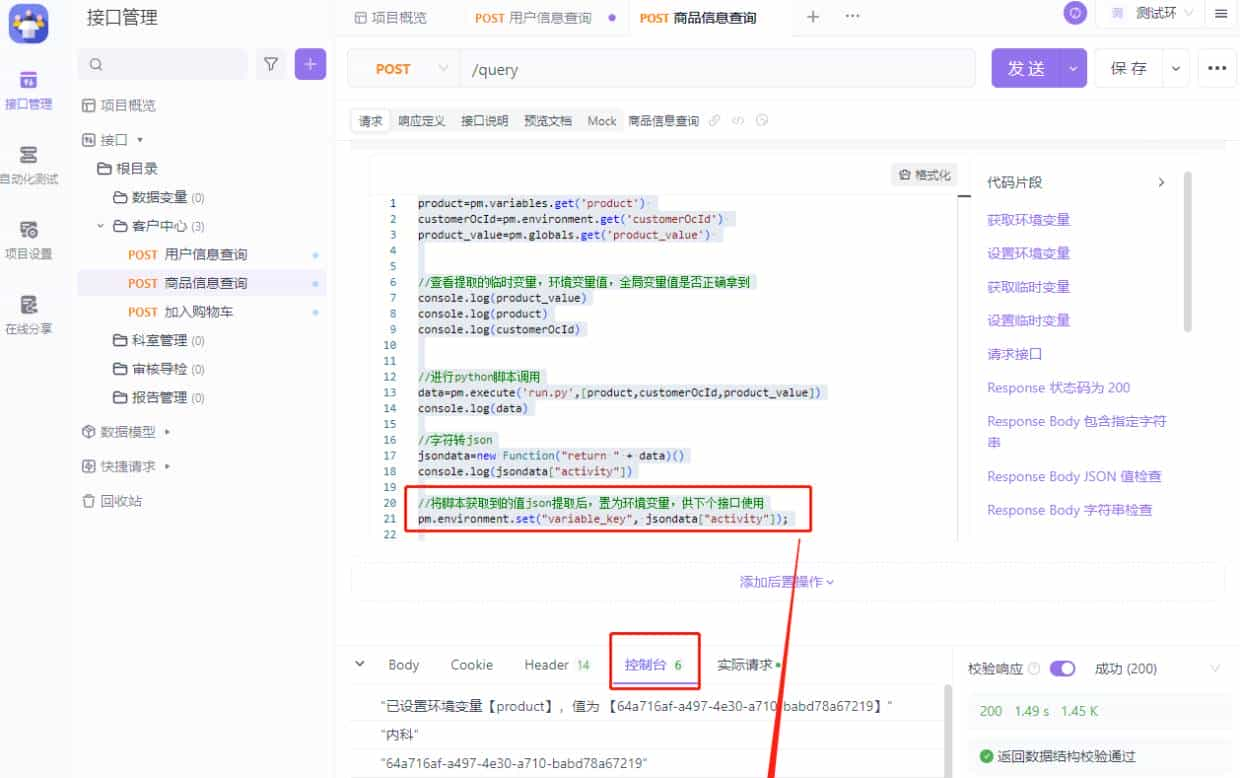

//字符转json

jsondata=new Function("return " + data)()

console.log(jsondata["activity"])

//将脚本获取到的值json提取后,置为环境变量,供下个接口使用

pm.environment.set("variable_key", jsondata["activity"]);

//如果有需要可将json转字符串

stringdata=JSON.stringify(jsondata)

console.log(stringdata)

4.python对数据进行处理和拼接的脚本run.py

作用:数据拼接后又组装成字典的形式返回

# run.py

import argparse

def apifox_test(product, customerOcId, product_value):

data = {}

data["product"] = product

data["customerOcId"] = customerOcId

data["product_value"] = product_value

data["activity"] = product_value + "科室在测试脚本调用该商品,商品信息为" + product

return data

if __name__ == __main__ :

parser = argparse.ArgumentParser()

parser.add_argument( product , type=str, default=None)

parser.add_argument( customerOcId , type=str, default=None)

parser.add_argument( product_value , type=str, default=None)

args = parser.parse_args()

respon = apifox_test(args.product, args.product, args.product_value)

print(respon)

将run.py文件放在apifox的外置程序中(操作步骤可查看上个文档)

5.控制台响应结果如下:

“内科科室在测试脚本调用该商品,商品信息为64a716af-a497-4e30-a710-babd78a67219”

后续的接口要使用拼接的这部分内容,可在对应位置直接使用{{variable_key}}即可

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...