近期,Deepseek R1的开源引爆了科技圈,不过,存在一个小缺憾,即该模型并非多模态模型,无法对图像进行理解。今天咱们就玩点骚操作,用Dify给R1装上“赛博义眼”,让它从纯文字模型进化为能看懂表情包的多模态战士!部署过程中也感谢腾讯云客服提供专业技术支持,赞一个。

一、安装Dify

前往腾讯云控制台创建云服务器(CVM)

也可以选择轻量应用服务器,已支持一键部署Dify

推荐配置:2核4G及以上

系统选择:Ubuntu 22.04 LTS

第一请出我们的老朋友Docker

wget -qO- get.docker.com | bash

拉取仓库并运行

git clone https://github.com/langgenius/dify.git –branch 0.15.3

cd dify/docker

cp .env.example .env

docker compose up -d

可能有小伙伴在执行上一条命令的时候遇到了拉取慢,拉取不了的问题,我们可以通过配置镜像源来解决这个问题

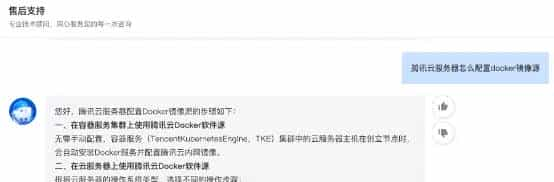

以下是我通过咨询腾讯云客服得到的解决方案

以本次所使用的Ubuntu为例

编辑/etc/default/docker文件

添加:

DOCKER_OPTS=”–registry-mirror=https://mirror.ccs.tencentyun.com”

再次执行docker compose up -d即可解决

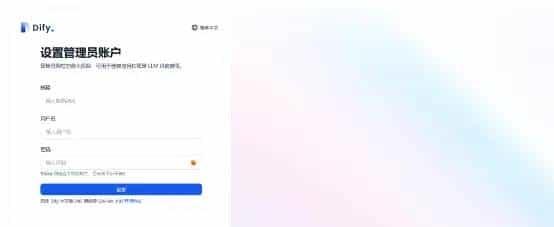

访问 http://你的服务器IP/install 出现安装界面即表明安装成功

二、部署模型

1.创建腾讯云高性能应用服务(HAI)

提议选择Ubuntu环境

如果选择境内地域提议在控制台开启学术加速

2.安装ollama

wget -qO- https://ollama.com/install.sh | sh

将ollama服务对外开放

停止ollama服务

systemctl stop ollama

编辑服务文件 /etc/systemd/system/ollama.service [service]标签下方添加

Environment=”OLLAMA_HOST=0.0.0.0″

Environment=”OLLAMA_ORIGINS=*”

重载文件以及启动ollama

systemctl daemon-reload

systemctl start ollama

打开IP:11434如果看到Ollama is running字样则成功开放

拉取模型

拉取r1模型(默认7b可以在后面添加如:1.5b来指定)

ollama pull deepseek-r1

以及llava模型(视觉模型)

ollama pull llava

三、配置模型参数

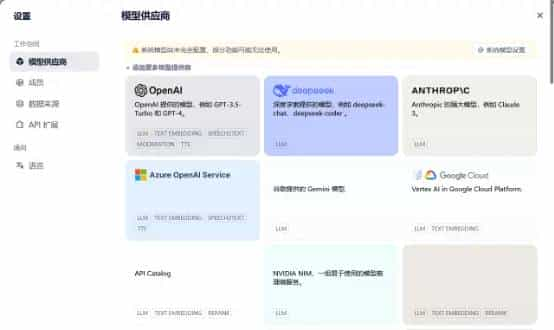

我们目前返回到dify的工作台,配置语言和图像识别模型。点击右上角头像->设置->模型供应商

添加ollama为模型供应商

基础URL:http://你的IP:11434

模型名称:上文拉取的模型名称

记得llava要勾选上“视觉”哦

配置完成如图

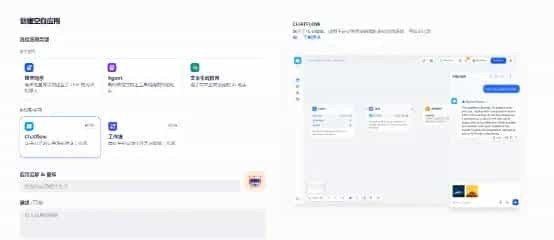

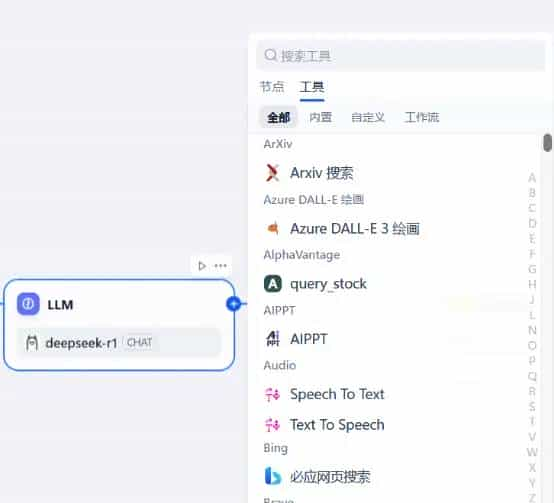

目前我们创建一个Chatflow

默认创建的工作流是这样的:

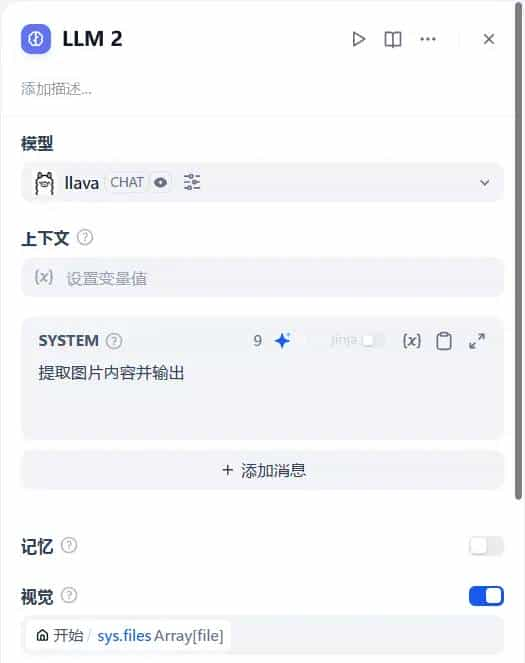

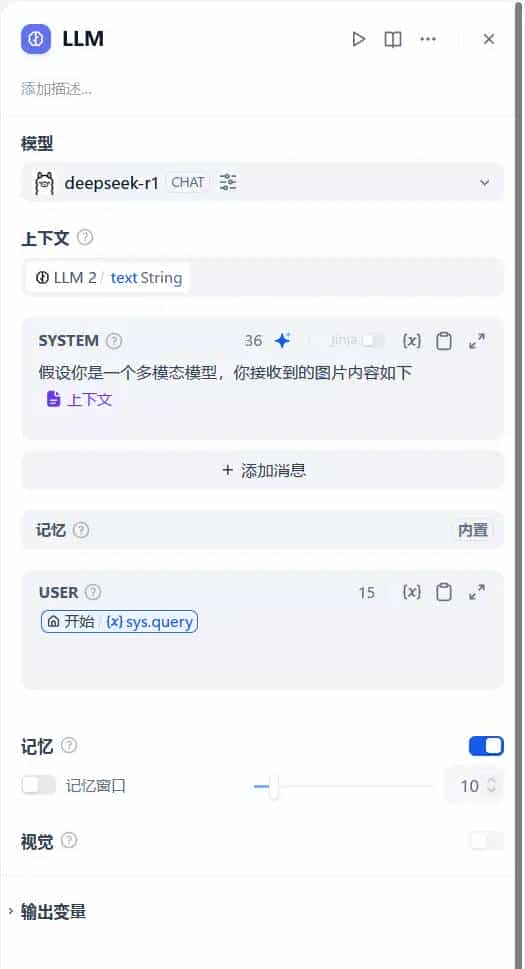

我们可以在R1的LLM前再添加一个LLM,模型选择llava

配置system prompt以及开启视觉功能

给chatflow添加文件上传功能

这样我们就简单配置了一个具备图像理解能力的R1模型。

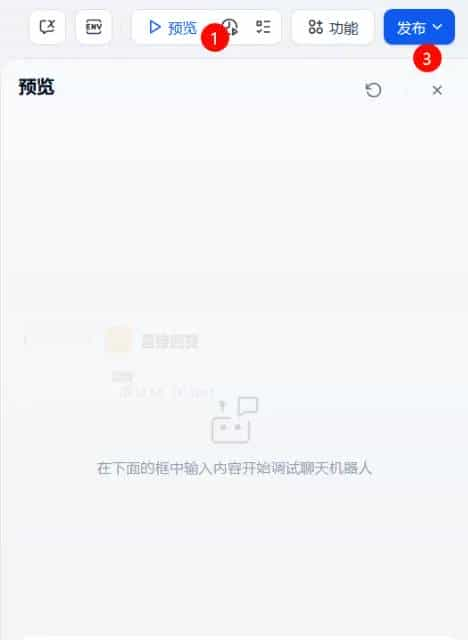

点击发布可以生成一个应用了此工作流的智能体

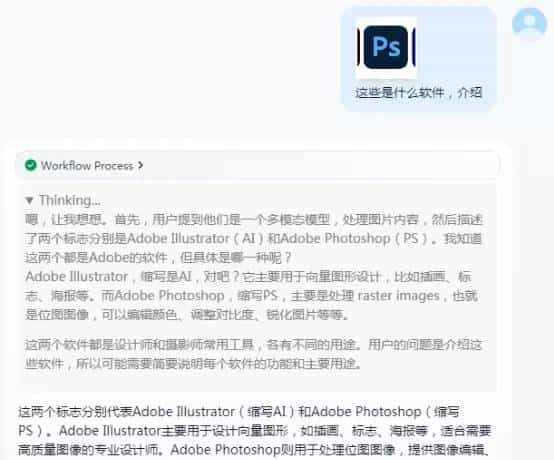

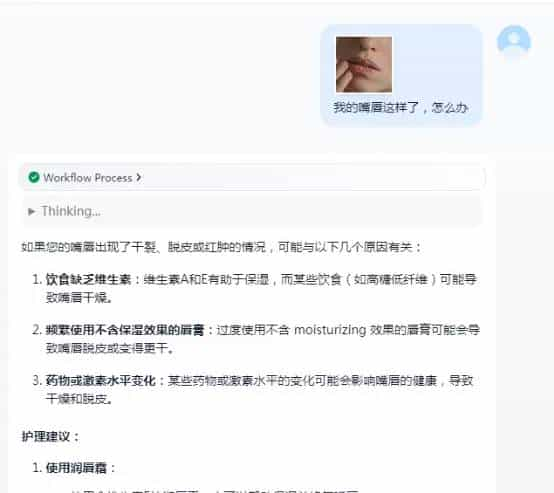

四、效果展示

我们成功给Deepseek R1添加了图像理解能力,来看看效果吧:

五、后记

最近在部署Ollama模型服务时,发现不少开发者直接使用默认配置对外开放服务,这实则存在不小的安全隐患。在此补充几个关键安全措施,供大家在生产环境中参考:

1.优先修改默认端口

通过修改服务端口能有效避免通用端口的扫描攻击,具体操作只需编辑服务文件

# 修改/etc/systemd/system/ollama.service

[Service]

Environment=”OLLAMA_PORT=自定义端口” # 添加在[Service]配置段下方

2. dify功能扩展

后续可通过添加“工具”为R1加上联网和绘画等能力

3. Nginx反向代理

提议配合Nginx实现IP白名单限制和SSL加密,既能隐藏真实端口,又能通过防火墙规则准确控制访问源(具体配置可根据业务需求灵活调整)。

值得一提的是,在配置过程中腾讯云的专业客服给了我很大协助——即便像”禁用root用户登录”这类基础安全设置,工程师也会通过远程协作耐心排查。特此记录部署经验,与各位共勉。

相关文章