智能资源调度AI引擎:重新定义AI应用架构师的核心能力边界

一、引言:AI架构师的“资源焦虑症”,该治了

凌晨2:58,张磊的手机突然震动——是监控系统的告警:推荐模型推理集群的GPU利用率跌至12%,而新上线的直播互动模型还在排队等待资源。他揉着眼睛打开电脑,看着Dashboard上红黄绿交错的曲线,想起上周业务部门刚要求“双11前必须支持10倍并发”,但硬件预算只批了30%。

这不是张磊第一次经历这种“资源危机”。作为某头部电商的AI应用架构师,他的日常像在走钢丝:

既要保证推荐、搜索、直播等核心模型的低延迟(比如推荐结果必须在100ms内返回),又要盯着成本红线(GPU集群月均成本不能超过200万),还要应对业务的动态变化(比如突然火起来的“ AI 试衣间”模型,需要临时占用50%的GPU资源)。

更痛苦的是,传统资源调度方式像“盲人摸象”:

用固定规则分配资源(比如给推荐模型预留30%的GPU),但波峰时不够用、波谷时闲置;靠人工经验调优(比如根据历史数据调整配额),但跟不上业务的周级迭代;对模型特性视而不见(比如Transformer模型的Batch Size和GPU内存的强关联),导致资源利用率常年低于30%。

直到去年引入智能资源调度AI引擎,张磊的“资源焦虑症”才终于缓解:引擎能实时感知业务负载、模型算力需求和硬件状态,自动把GPU资源分配给最需要的模型——双11期间,GPU利用率从28%提升到65%,延迟下降了27%,成本反而减少了15%。

这不是个例。根据Gartner 2024年报告,83%的AI应用团队已将“智能资源调度”列为核心技术投入,而这一趋势正在深刻改变AI应用架构师的职业格局:

我们不再是“资源搬运工”,而是“策略设计师”;不再依赖“经验直觉”,而是“数据与算法驱动”;不再局限于“单系统优化”,而是“跨层协同的总架构师”。

这篇文章,我会从传统调度的痛点、智能引擎的核心逻辑、职业能力的重构三个维度,帮你理解:智能资源调度AI引擎,到底如何重新定义AI架构师的工作。

二、传统AI资源调度的“三大死局”:为什么经验不再管用?

要理解智能引擎的价值,先得捅破传统调度的“窗户纸”——那些让架构师崩溃的问题,本质上是**“静态规则”与“动态AI场景”的矛盾**。

1. 死局1:推理场景的“波峰波谷”,规则引擎跟不上

AI推理(Inference)是最常见的资源消耗场景——比如电商的推荐模型、短视频的内容审核、银行的欺诈检测。这些场景的特点是负载波动极大:

电商大促时,推荐请求量是平时的10倍;短视频的“晚8点高峰”,内容审核请求量骤增5倍;银行的“工资日”,欺诈检测模型的调用量翻3倍。

传统调度用**“预留+扩容”**的规则应对:比如给推荐模型预留40%的GPU,波峰时自动扩容2倍。但问题来了:

预留太多,波谷时资源闲置(比如凌晨3点,推荐模型的GPU利用率可能跌到5%);扩容太慢,波峰时延迟飙升(比如大促开场10分钟,推荐结果延迟从80ms涨到200ms,导致用户流失);扩容太频繁,成本爆炸(比如每扩容一次,云厂商按小时计费,而波峰可能只持续30分钟)。

2. 死局2:训练场景的“资源碎片”,人工调优效率低

AI训练(Training)的资源需求更“任性”:

一个BERT大模型训练需要8张A100 GPU,持续72小时;一个小的分类模型训练只需要1张T4 GPU,1小时就能完成;多租户场景下(比如公司内多个算法团队共享集群),资源很容易被“碎片化”——比如剩下3张GPU,不够大模型用,小模型又用不完。

传统调度靠**“人工分配”**:架构师每周开一次资源协调会,给各个团队分配配额。但这种方式的问题是:

响应慢:算法团队要训练新模型,得等一周才能拿到资源;利用率低:比如某团队的配额是10张GPU,但这周只用到3张,剩下的7张只能闲置;冲突多:两个团队同时要大模型训练资源,架构师得“凭关系”协调。

3. 死局3:混合负载的“资源抢占”,系统稳定性崩溃

很多公司的AI集群是混合负载:既跑推理(低延迟、高并发),又跑训练(高算力、长周期)。传统调度没有“优先级感知”,很容易出现:

训练任务抢占了推理的GPU资源,导致推荐模型延迟暴涨;推理任务的波峰挤掉了训练任务,导致模型训练中断,需要重新开始;硬件资源被“卡死”:比如某训练任务占用了GPU的全部内存,推理任务连1MB都分配不到。

传统调度的本质问题:“人治”无法应对“AI的动态性”

AI系统的核心特点是**“三动态”**:

业务动态:用户需求、流量模式随时变化;模型动态:模型大小、算力需求、延迟要求各不相同;硬件动态:GPU的利用率、内存占用、温度等状态实时变化。

而传统调度是**“静态规则+人工经验”**,本质上是用“过去的经验”应对“未来的变化”——就像用固定路线的导航仪,应对实时路况的拥堵。

三、智能资源调度AI引擎:从“规则驱动”到“算法驱动”的革命

智能资源调度AI引擎的出现,就是为了解决“动态性”问题。它不是传统调度器的“升级版”,而是用AI解决AI的问题——用机器学习、强化学习等技术,让系统“学会”如何最优分配资源。

1. 什么是智能资源调度AI引擎?

简单来说,它是一个**“感知-决策-执行-反馈”的闭环系统**:

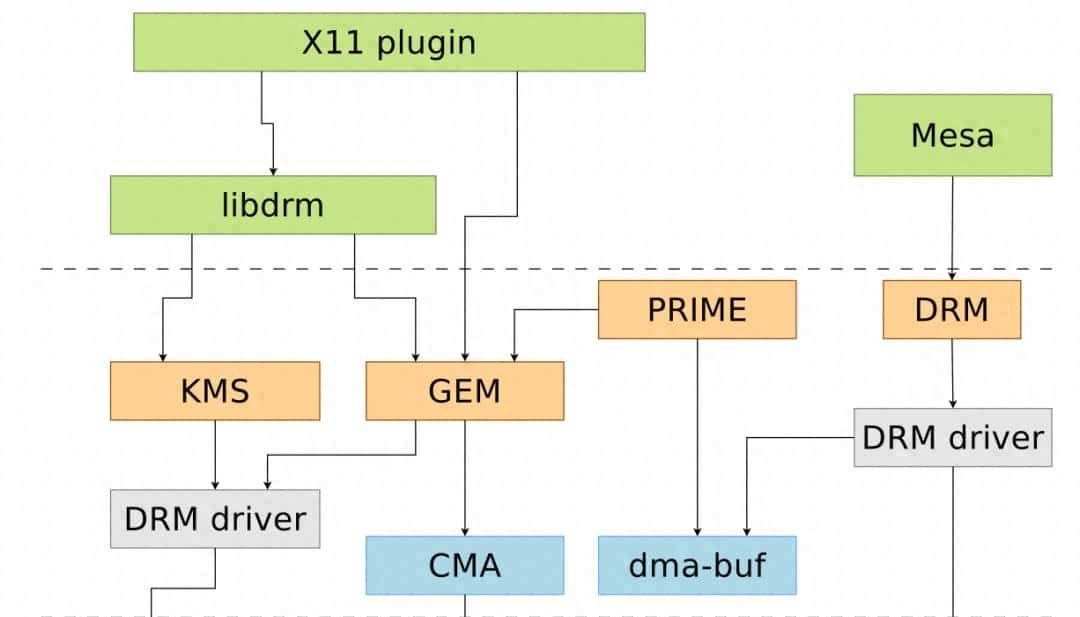

感知层:收集所有与资源相关的数据(硬件状态、业务负载、模型特征);决策层:用算法模型计算最优的资源分配策略;执行层:将策略转化为实际的资源调度操作(比如调整k8s的Pod分配);反馈层:监控策略的效果,反过来优化算法模型。

举个具体的例子:当电商大促的推荐请求量骤增时,引擎会:

感知层:实时收集推荐模型的请求QPS(比如从1万涨到10万)、GPU的利用率(比如从30%涨到80%)、模型的延迟(比如从80ms涨到120ms);决策层:用强化学习模型计算——“需要给推荐模型增加3张A100 GPU,同时把非核心的训练任务暂停2小时”;执行层:调用k8s的调度器插件,将3张GPU分配给推荐模型,并暂停训练任务;反馈层:监控调整后的延迟(比如降到90ms)和GPU利用率(比如涨到75%),如果效果好,就强化这个策略;如果不好,就调整算法参数。

2. 智能引擎的核心模块解析:从“数据”到“策略”的全链路

要理解智能引擎的工作原理,我们需要拆解它的四大核心模块:

(1)感知层:用“全维度数据”替代“局部信息”

感知层是智能引擎的“眼睛”,它需要收集三类关键数据:

硬件状态数据:GPU/CPU的利用率、内存占用、温度、功耗;业务负载数据:推理请求的QPS、延迟、错误率;训练任务的进度、算力需求;模型特征数据:模型的类型(比如Transformer、CNN)、大小(比如10亿参数)、Batch Size、精度(比如FP32/FP16)、对GPU内存的需求。

举个例子,一个Transformer推荐模型的特征数据可能是:

模型大小:15亿参数;Batch Size:64;GPU内存需求:16GB(FP16);延迟要求:≤100ms;算力需求:每秒钟需要处理1000个Token。

这些数据不是“死的”,而是实时更新的——比如当模型的Batch Size从64调整到128时,感知层会立刻捕捉到,并更新模型的算力需求。

(2)决策层:用“AI算法”替代“人工规则”

决策层是智能引擎的“大脑”,它的核心是多目标优化算法——在满足多个约束条件的前提下,找到最优的资源分配策略。常见的算法有三类:

① 预测模型:提前感知“未来的变化”

预测模型的作用是预判负载的变化,比如用LSTM模型预测未来1小时的推荐请求QPS,用时间序列模型预测训练任务的完成时间。这样引擎就能“提前调度”,而不是“事后救火”。

比如,某电商的预测模型发现“晚8点的推荐请求量会涨到平时的5倍”,那么引擎会在7:30就开始为推荐模型预留GPU资源,避免波峰时延迟飙升。

② 强化学习(RL):让系统“学会”最优策略

强化学习是智能引擎的“核心武器”——它通过“试错”学习最优的资源分配策略,就像训练AlphaGo下围棋一样。

强化学习的三大要素:

状态(State):当前的硬件状态、业务负载、模型特征;动作(Action):比如“给推荐模型增加2张GPU”“暂停训练任务A”;奖励(Reward):衡量动作的好坏(比如“延迟降低10ms得+10分,成本增加5%得-5分”)。

举个例子,当系统处于“推荐模型延迟120ms,GPU利用率70%”的状态时,引擎尝试“增加2张GPU”的动作:

如果延迟降到90ms(满足SLA),GPU利用率涨到85%(提高利用率),那么奖励是+15分;如果延迟降到80ms,但GPU利用率涨到95%(接近满载,有崩溃风险),那么奖励是+5分;如果延迟没变化,但成本增加了10%,那么奖励是-10分。

通过不断试错,强化学习模型会“学会”:在延迟超标的情况下,增加2张GPU是最优动作。

③ 多目标优化:平衡“性能、成本、稳定性”

AI资源调度的核心是平衡多个目标:

性能:满足模型的延迟、吞吐量要求;成本:最小化硬件或云资源的支出;稳定性:避免资源抢占导致的系统崩溃。

多目标优化算法(比如NSGA-II)的作用是,在这些目标之间找到“帕累托最优”——比如“在延迟不超过100ms的前提下,成本最小”;或者“在成本不超过200万的前提下,延迟最低”。

架构师的核心工作之一,就是定义这些目标的优先级——比如对于推荐模型,优先级是“延迟>成本>利用率”;对于训练模型,优先级是“成本>利用率>时间”。

(3)执行层:用“云原生接口”替代“手动操作”

执行层是智能引擎的“手脚”,它需要将决策层的策略转化为实际的操作。现在主流的执行层都是云原生的——比如基于Kubernetes(k8s)的调度器插件,或者云厂商的API(比如AWS的EC2 Auto Scaling)。

举个例子,当决策层决定“给推荐模型增加2张A100 GPU”时,执行层会:

调用k8s的Scheduler Plugin,在集群中找到空闲的A100 GPU节点;创建新的Pod,绑定到这些节点上;将推荐模型的流量路由到新的Pod上;监控Pod的启动状态,确保没有故障。

(4)反馈层:用“闭环迭代”替代“一次性决策”

反馈层是智能引擎的“学习环路”,它会监控策略的执行效果,并将结果反馈给决策层,优化算法模型。

比如,当引擎执行“增加2张GPU”的策略后,反馈层会收集:

推荐模型的延迟:从120ms降到90ms(符合预期);GPU利用率:从70%涨到85%(符合预期);成本:增加了8%(在预算内)。

如果效果好,反馈层会让决策层“强化”这个策略;如果效果不好(比如延迟没降,成本反而增加了15%),反馈层会让决策层调整算法参数(比如降低增加GPU的数量)。

3. 智能引擎 vs 传统调度:到底强在哪里?

我们用一张表对比两者的核心差异:

| 维度 | 传统调度 | 智能引擎 |

|---|---|---|

| 驱动方式 | 规则+经验 | 数据+算法 |

| 响应速度 | 分钟级/小时级 | 秒级/亚秒级 |

| 资源利用率 | 20%-30% | 50%-70% |

| 目标平衡 | 单一目标(比如只看延迟) | 多目标(性能+成本+稳定性) |

| 适应性 | 无法应对动态变化 | 自动学习、迭代优化 |

四、智能引擎如何重构AI架构师的职业能力?

智能资源调度AI引擎的出现,不是“取代”架构师,而是将架构师从“重复性劳动”中解放出来,转向更有价值的“策略设计”和“跨层协同”。

1. 从“资源搬运工”到“策略设计师”:定义“什么是最优”

传统架构师的日常是“调配额、扩节点、杀进程”——就像工厂里的“搬运工”,把资源从A搬到B。而智能引擎普及后,架构师的核心工作变成定义“最优策略的目标”:

对于推荐模型,你需要明确:“延迟不超过100ms,成本不超过每月150万,GPU利用率不低于50%”;对于训练模型,你需要明确:“训练时间不超过72小时,成本不超过2万,不抢占推理资源”;对于混合负载,你需要明确:“推理任务的优先级高于训练任务,训练任务可以暂停但不能中断”。

这些“目标定义”不是拍脑袋来的,而是基于业务价值的深度思考——比如推荐模型的延迟每降低10ms,转化率能提高2%,所以“延迟优先于成本”;而训练模型的成本每降低10%,算法团队的预算能多做2个实验,所以“成本优先于时间”。

举个例子,某短视频公司的架构师李阳,针对“内容审核模型”定义了这样的目标函数:

这个函数的含义是:延迟的权重最高(60%),成本次之(30%),利用率最低(10%)——因为内容审核的延迟直接影响用户体验(比如用户发视频后,要等1秒才能看到“审核通过”),而成本和利用率是次要的。

李阳的工作不再是“调资源”,而是不断优化这个目标函数——比如当业务部门要求“审核延迟必须≤80ms”时,他会把延迟的权重从60%提高到70%;当成本超支时,他会把成本的权重从30%提高到40%。

2. 从“经验驱动”到“数据驱动”:用数据验证策略的效果

传统架构师依赖“经验直觉”——比如“推荐模型需要预留30%的GPU”,“训练任务的配额给算法团队A多一点”。而智能引擎要求架构师用数据验证每一个决策:

你需要知道:“增加1张GPU,能让推荐模型的延迟降低多少?成本增加多少?”你需要知道:“暂停训练任务B,能释放多少资源?对训练进度的影响有多大?”你需要知道:“用FP16精度训练模型,能减少多少GPU内存占用?对模型精度的影响有多大?”

这些问题的答案,不是来自经验,而是来自数据的分析与实验。

比如,某银行的架构师王敏,想要优化欺诈检测模型的资源利用率。她做了三个实验:

实验1:将模型的Batch Size从32调整到64——GPU利用率从40%涨到55%,延迟从90ms涨到105ms(超过SLA);实验2:用TensorRT优化模型——GPU利用率从40%涨到60%,延迟从90ms降到80ms(符合SLA);实验3:将模型部署到边缘节点——GPU利用率从40%涨到50%,延迟从90ms降到75ms(但边缘节点的成本比云节点高20%)。

通过数据对比,王敏选择了实验2:用TensorRT优化模型,既提高了利用率,又满足了延迟要求,成本也没有增加。

3. 从“单系统专家”到“跨层协同者”:打通“硬件-软件-业务”的边界

传统架构师通常是“单领域专家”——比如懂k8s的调度,或者懂深度学习框架,但很少有人能打通“硬件-软件-业务”的边界。而智能引擎要求架构师成为**“跨层协同者”**:

你需要懂硬件:比如A100 GPU的内存带宽是多少?TPU的浮点算力比GPU高多少?边缘设备的算力限制是什么?你需要懂软件:比如k8s的调度框架如何扩展?TensorRT如何优化模型?PyTorch的分布式训练如何占用资源?你需要懂业务:比如推荐模型的转化率与延迟的关系?欺诈检测模型的准确率与算力的关系?业务部门的预算限制是什么?

举个例子,某自动驾驶公司的架构师陈飞,要优化感知模型的推理资源。他做了这样的跨层协同:

硬件层:选择带有NVMe SSD的GPU节点——因为感知模型需要加载大量的点云数据,NVMe SSD的读取速度比SATA SSD快3倍,能减少数据加载时间;软件层:用TensorRT将模型从FP32量化到FP16——减少GPU内存占用30%,同时保持模型精度下降不超过1%;业务层:与算法团队对齐——感知模型的延迟要求是≤200ms(因为自动驾驶需要实时决策),所以调度策略优先分配高算力的GPU节点给感知模型。

通过跨层协同,陈飞把感知模型的GPU利用率从35%提高到65%,延迟从220ms降到180ms,满足了业务需求。

4. 从“问题解决者”到“风险预控者”:提前化解“看不见的危机”

传统架构师的工作是“救火”——比如资源不够了,就加硬件;延迟高了,就调配额。而智能引擎让架构师成为**“风险预控者”**:通过预测模型,提前发现潜在的资源瓶颈,并制定应对策略。

比如,某电商的架构师张磊,用智能引擎的预测模型发现:“双11当天10点,推荐请求量会涨到平时的12倍,而当前的GPU资源只能支持8倍”。于是他提前做了三件事:

与云厂商协商,预留10张A100 GPU的“弹性资源”——双11当天10点自动扩容;与算法团队合作,将推荐模型的Batch Size从64调整到128——提高GPU利用率20%;将非核心的训练任务暂停4小时——释放5张GPU资源。

双11当天,推荐模型的延迟稳定在95ms,GPU利用率达到70%,没有出现任何资源危机。

总结:AI架构师的“新能力模型”

智能资源调度AI引擎普及后,AI架构师需要具备的核心能力可以总结为“三个一”:

一个思维:数据驱动的思维——用数据验证决策,而不是经验;一个技能:跨层协同的技能——打通硬件、软件、业务的边界;一个角色:策略设计的角色——定义“什么是最优”,而不是“怎么搬运资源”。

五、案例研究:某电商的智能调度实践,如何让GPU利用率翻2倍?

为了更直观地理解智能引擎的价值,我们来看一个真实案例:某头部电商的智能资源调度实践。

1. 背景:资源利用率低,成本压力大

该电商的AI推理集群有500张GPU(主要是A100和T4),运行推荐、搜索、直播互动三个核心模型。痛点是:

GPU利用率常年在25%-30%之间;大促期间延迟经常超过150ms(目标是≤100ms);月均成本高达300万,远超预算。

2. 解决方案:引入智能资源调度AI引擎

该电商选择了基于强化学习的智能调度引擎,核心做法是:

感知层:收集了100+个指标(GPU利用率、内存占用、请求QPS、延迟、模型特征等);决策层:用PPO(Proximal Policy Optimization)强化学习算法,定义了“延迟≤100ms,成本≤250万,利用率≥50%”的目标函数;执行层:基于k8s的Scheduler Plugin,实现了“秒级调度”;反馈层:每小时更新一次模型参数,优化策略。

3. 结果:利用率翻2倍,成本降15%

实施3个月后,效果显著:

GPU利用率从28%提升到65%;推荐模型的延迟从120ms降到90ms;月均成本从300万降到255万(减少15%);架构师的工作时间:从每天8小时调资源,降到每周10小时优化策略。

4. 经验教训:避免踩这些“坑”

该电商的架构师分享了三个关键经验:

一定要对齐业务SLA:一开始目标函数定义错了(把利用率的权重设得太高),导致延迟超过100ms,后来调整为“延迟权重最高”才解决;要考虑模型的冷启动时间:比如新扩容的Pod需要加载模型权重(需要30秒),一开始没考虑,导致调度后延迟飙升,后来加了“冷启动预测模型”,提前30秒扩容;要与算法团队协同:比如算法团队优化模型后,模型的算力需求减少了20%,架构师需要及时更新感知层的模型特征数据,否则调度策略会失效。

六、未来趋势:AI架构师的“AI原生”能力要求

智能资源调度AI引擎的发展,还在加速。未来5年,AI架构师需要应对以下三大趋势:

1. 趋势1:智能调度与模型自动优化的融合

未来,智能调度引擎会与**模型自动优化(AutoML)**深度融合——比如:

调度引擎会自动调整模型的Batch Size(比如从64调到128),以提高GPU利用率;调度引擎会自动选择模型的精度(比如从FP32调到FP16),以减少GPU内存占用;调度引擎会自动优化模型的结构(比如剪枝、量化),以降低算力需求。

这意味着,架构师需要懂AutoML的基础——比如模型剪枝的原理、量化的影响,才能更好地设计调度策略。

2. 趋势2:跨云/边缘的智能调度

随着边缘计算的普及,未来的AI资源会分布在云、边缘、端三个层面:

云:负责大模型训练、高并发推理;边缘:负责低延迟推理(比如自动驾驶的感知模型);端:负责轻量级推理(比如手机上的人脸解锁)。

智能调度引擎需要跨云/边缘/端分配资源——比如把用户的推荐请求分配到离用户最近的边缘节点,以降低延迟;把大模型训练任务分配到云节点,以利用高算力。

这要求架构师懂边缘计算的基础——比如边缘节点的算力限制、网络延迟,才能设计跨层的调度策略。

3. 趋势3:“无代码”调度策略设计工具

未来,智能调度引擎会提供无代码的策略设计工具——比如用可视化界面定义目标函数,用拖拽的方式配置策略。但这并不意味着架构师的工作变简单了,反而要求更高:

你需要更深入地理解业务价值,才能正确定义目标函数;你需要更懂算法的原理,才能判断工具生成的策略是否合理;你需要更懂系统的边界,才能避免策略的“副作用”(比如导致系统崩溃)。

七、结论:智能引擎不是“取代”,而是“释放”架构师的创造力

回到文章开头的问题:智能资源调度AI引擎,到底如何改变AI应用架构师的职业格局?

答案是:它让架构师从“体力劳动”转向“脑力劳动”,从“解决具体问题”转向“设计系统的核心逻辑”。

传统架构师的价值是“把资源搬对地方”,而未来架构师的价值是“定义‘对的地方’是什么”——比如:

什么是业务的核心价值?(延迟、成本、利用率,哪个更重要?)什么是模型的最优状态?(Batch Size、精度、结构,哪个更适合当前的资源?)什么是系统的边界?(跨云/边缘的资源如何协同?)

最后,我想对所有AI应用架构师说:

智能资源调度AI引擎不是“对手”,而是“伙伴”——它帮你解决了最头疼的资源问题,让你有更多时间去思考更本质的问题:如何让AI系统更高效地服务于业务价值。

下次遇到资源瓶颈时,别着急加硬件,先想想:能不能用智能调度优化策略?

下次设计系统时,别只考虑“功能实现”,先想想:如何定义最优的资源调度目标?

未来的AI架构师,不是“资源的管理者”,而是“价值的设计者”——而智能资源调度AI引擎,就是你最有力的工具。

八、附加部分

1. 参考文献/延伸阅读

《Borg: The Google Cluster Scheduler》(Google的集群调度系统论文);《Kubernetes Scheduling Framework》(k8s调度框架文档);《Reinforcement Learning for Resource Management in Cloud Computing》(强化学习在云资源管理中的应用论文);《Gartner Top Trends in AI Infrastructure 2024》(Gartner 2024年AI基础设施趋势报告)。

2. 作者简介

我是李默,10年AI基础设施与云原生领域经验,曾在阿里、字节负责AI资源调度系统的设计与实现。现在是一名技术博主,专注于分享AI架构师的实战经验。我的公众号“AI架构师之路”,每周更新一篇深度文章,覆盖AI资源调度、云原生、大模型部署等领域。

3. 行动号召

如果你是AI应用架构师,欢迎在评论区分享你的“资源调度痛点”——比如你遇到过最崩溃的资源问题是什么?你是如何解决的?

如果你还没使用过智能资源调度AI引擎,不妨从这三步开始:

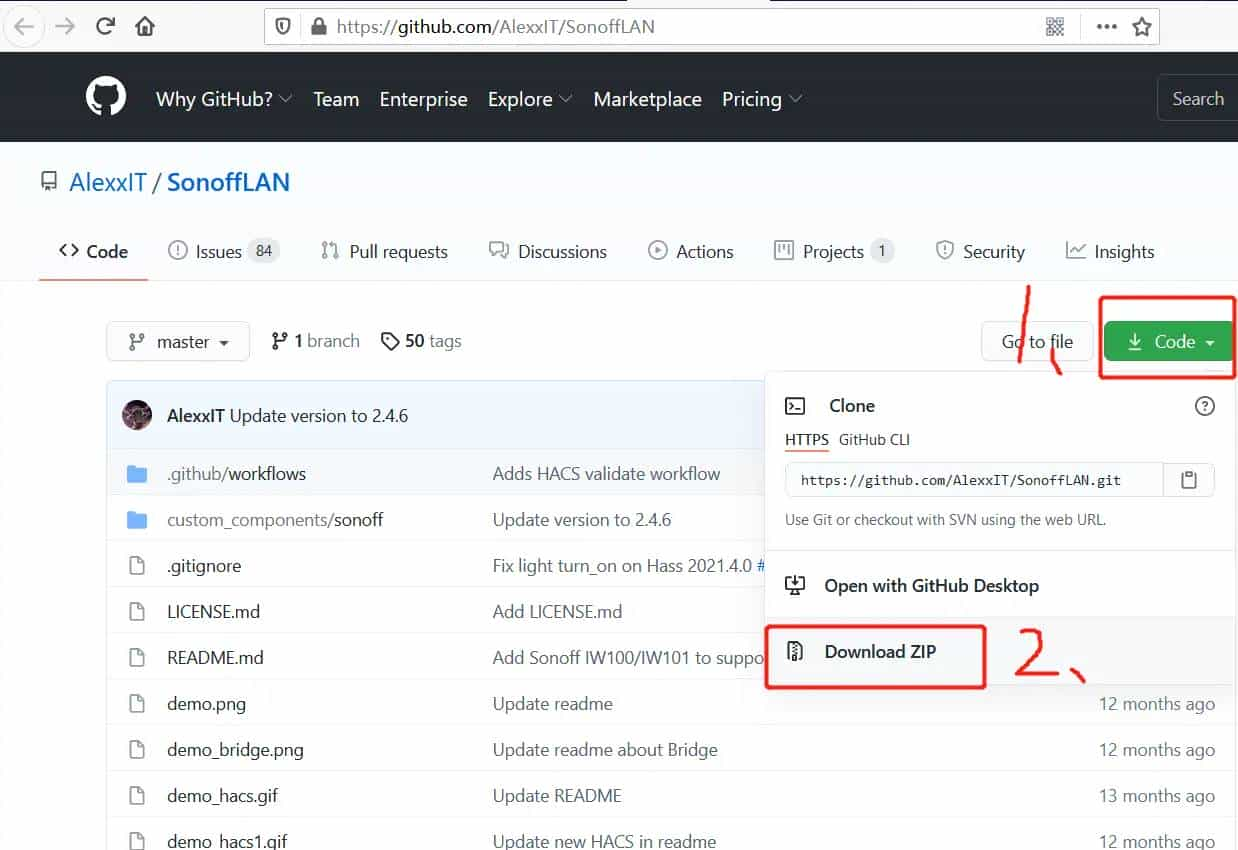

收集你的AI系统的资源数据(硬件状态、业务负载、模型特征);定义一个简单的目标函数(比如“延迟≤100ms,利用率≥50%”);找一个开源的智能调度引擎(比如Kubeflow的Katib),尝试运行一个小实验。

期待你的分享!

相关文章