字节跳动目前在好几个技术方向上都有了挺具体的成果:XR 的显示和实时追踪已经做到接近视网膜级清晰度,头显端到端延迟测到约 12 毫秒;大模型服务在市场上有了商业化产品(豆包、火山引擎),据 IDC 火山在中国 MaaS 市场排第一;在科学计算方面,团队把神经网络量子蒙特卡洛推到能做固体材料和二维转角材料的等级,找到了可扩展的规律。说完结果,往回讲过程。

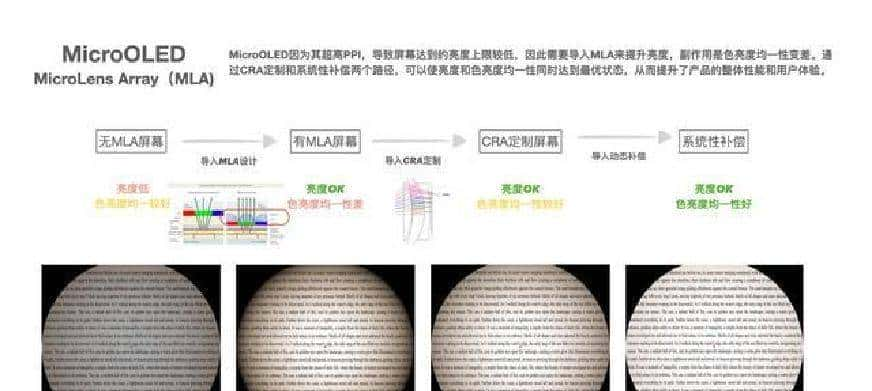

最近几年在 XR 上的投入比较直接。2021 年收购了 Pico 后,内部分成两条路:一条主攻内容和市场,一条扎实做核心硬件技术。到 2023 年,公司把重心往技术路线压了,减少了内容投入,目标是把硬件体验拉上来。做什么先?清晰度和融合感是两大瓶颈。想把头显的视觉体验接近真实,需要把每度像素数(PPD)做高。市面上主流设备 PPD 多在 20 以下,连看清小字都有问题。团队从 2022 年起和供应商定制 MicroOLED,目标把单眼像素密度推到一个很高的量级,最后把平均 PPD 做到 40,中心区域超过 45。MicroOLED 本身像素极小,亮度受限,团队通过加微透镜、光学定制和色亮度补偿一并解决,才把清晰度和均匀度兼顾起来。

除了显示,混合现实需要实时把虚拟物体和现实叠到一起。这牵扯到 SLAM、畸变逆向校正、运动补偿、低延迟渲染等一大堆算力密集的东西。为了解决功耗和时延矛盾,2022 年立项做自研头显芯片,2024 年回片并进入量产。实测系统端到端延迟能降到大约 12 毫秒,这个水平放在消费设备里是相当难得的。为保证交互鲁棒性,又搭建了高精度的 ground truth 测试系统,做眼动、手势的 3D 重建和数据采集,只有拿到大量标注数据,交互模型才能在不同人群上表现稳定。

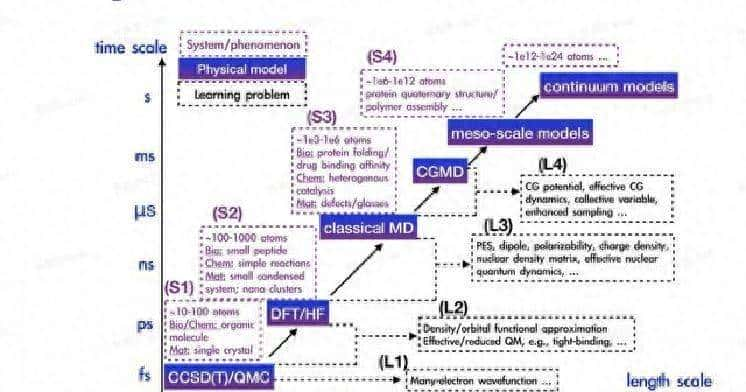

再往前看,ByteDance 在 AI for Science 上也投入不少。2020 年左右,团队开始把机器学习放到科研仿真里,目标是用大规模模拟和 ML 相互促进。早期关注的是用神经网络来表明量子体系的波函数,走 NNQMC(神经网络量子蒙特卡洛)路线。团队把这套方法扩展到固体体系,做出了 DeepSolid,能处理二维转角材料,甚至用仿真找到 MoTe2 在特定密度和旋转角度下出现拓扑绝缘体的条件,和实验吻合。拓扑绝缘体的魅力在于边缘导电而内部绝缘,器件几乎不发热,未来对超低耗能计算、甚至特殊处理器设计有潜在价值。

在分子动力学方面,先把“正问题”做精——用更高精度的 DFT 作为 label,训练更准确的力场。团队实现了 GPU 加速的 PySCF(GPU4PySCF),把原来需要上百到上千核 CPU 才能完成的任务,压缩到一块 GPU 上,算力成本下降接近一个量级。有了更好标签,推出了 Bamboo-MLFF、ByteFF 等力场模型,ByteFF-Pol 在无实验数据的零样本电解液性质预测上拿到业界领先精度。产业化也有动作,今年和 BYD 建立联合实验室,把高通量实验与计算结合,开始在电池材料上做落地。

科学计算里还有个好消息:在 NNQMC 方向发现了类似大模型里 scaling law 的表现(LAVA 项目),参数更多时仿真精度持续提升,说明把模型做大可能带来可观的实用性进步。这给后续在精度和体系规模上扩展提供了理论基础。

说到大模型的发展,这里也有几段必须交代的时间线。2021 年,字节内部有人训练出一个大语言模型,团队当时尝试把它用于搜索相关性任务,微弱的效果提升不足以抵消显著增加的计算成本,最后判断“暂时没用”。后来 2022 年 11 月 30 日 ChatGPT 爆发式走红,外界反应让公司迅速调整:从 2022 年开始大规模在这一方向投入。目前的成果里有面向用户的对话产品“豆包”,也有对企业开放的大模型服务——火山引擎的 MaaS,根据 IDC 数据,火山在中国市场位列第一。技术面上,得益早期基础设施积累,公司建设了大规模训练系统 MegaScale,浮点运算利用率(MFU)超过 55%,比主流开源框架高出不少,这帮忙把训练和调用成本往下拉,使得服务能在市场上有竞争力的价格与毛利。

再往前追溯到招聘杨震原那段。2014 年,张一鸣向他描述了用大规模机器学习搭建推荐系统的想法,目标是同时覆盖文字、图片、视频等多模态内容。这在当时看起来挺激进:行业里成熟做法多是在搜索广告里的大规模离散 LR。团队当时定了一个高标——把特征规模推向万亿级别。那几年工程和算法上的挑战许多:存储、计算、模型优化、在线更新机制等。优化器上团队做了两条线:一条是基于累计梯度、带 L1 正则的 FTRL(类似 AdaGrad 风格的自适应 SGD),另一条是 CDN(Coordinate Descent Newton)。CDN 起步不错,但上线后遇到问题,花了两年也未能达到目标,最后停止并把人员调到了其他重大业务。FTRL 上线速度快,几个月内就实现了稀疏化万亿特征的目标,系统从一开始就是 streaming training 的架构。后来逐步引入 FM 类算法,再演化成更通用的深度学习体系。到目前,浅层的 streaming 更新模型在推荐里仍有竞争力,这一点挺让人意外,但实际如此。

技术路径里还有许多细节:早期团队小,许多决定靠试错推动;一些看似失败的探索,反而把人和经验输送到更关键的岗位上。公司对这些尝试的容忍度,也让后续许多方向能快速起势。

最后有个开放性的问题常被提起:什么算是 AGI?一种比较直观的思考是,把全世界的工作都列出来,如果 AI 能完成其中绝大多数,列如 95%,那或许可以说接近 AGI。目前大模型在某些任务上超越大多数人(国际数学奥林匹克这种例子),但在许多“靠学习和交互即可胜任的常规岗位”上,还做不到。造成差距的一个缘由是学习方式:现有模型多是训练后固定推理,线上少有持续学习能力,不能像人那样通过社会互动快速适应新任务。另一个是 IO 能力,也就是和现实世界的交互能力,光是生成图像或视频不够,理解复杂界面、实时操作、感知物理世界这些方面依旧有差距。对此类基本问题的研究还许多,也的确 值得投入人力去攻关。

相关文章