过去几年,以 GPT-4、Claude 3 为代表的大型语言模型(LLM)凭借万亿级参数构建的 “智能巨塔”,彻底改变了人们对 AI 的认知 —— 它们能写代码、创作文本、解答复杂问题,成为科技领域的 “明星产物”。但在实际应用中,许多场景并不需要 LLM 的 “全能身手”:手机语音助手不需要理解天体物理,工业传感器的故障预警也无需生成诗歌。这种 “大材小用” 的矛盾,催生了小型语言模型(SLM)的崛起 —— 它们以更紧凑的规模、更低的门槛,让强劲的 AI 能力真正走进消费级设备与中小企业。

一、什么是 SLM?——“小” 是相对的,“能用” 才是核心

提到 “小型语言模型”,许多人会疑惑:10 亿参数的模型真的 “小” 吗?实际上,SLM 的 “小” 是相对于 LLM 而言的 ——LLM 参数常达数百亿甚至数万亿,而 SLM 的参数规模一般在100 万到 100 亿之间,是 LLM 的 “精简版”。

但 “精简” 不代表 “缩水”。SLM 保留了自然语言处理的核心能力:文本生成、摘要提炼、多语言翻译、问答交互等功能一个不少。列如微软 Phi-3.5-Mini(38 亿参数)能流畅生成代码,阿里 Qwen2.5-1.5B(15 亿参数)可精准处理中英双语任务,它们就像 “轻量化跑车”—— 虽没有 “重型卡车” 的载重能力,却能在城市道路(消费级设备)上灵活穿梭。

行业内对 “SLM” 的称呼也有过争议:有人觉得 “10 亿参数不算小”,提议叫 “小型大型语言模型”,但拗口的表述终究抵不过实用性 —— 如今 “SLM” 已成为通用术语,核心判断标准只有一个:能否在资源受限环境中高效运行。

二、SLM 如何 “瘦身”?—— 四大技术让模型 “轻装上阵”

将 LLM 压缩成 SLM,不是简单的 “砍参数”,而是通过精密技术在 “体积” 与 “性能” 间找到平衡。目前主流的 “瘦身手段” 有四种:

1. 知识蒸馏:让 “学生” 学透 “老师” 的本事

这是最常用的技术之一:用性能强劲的 LLM(如 GPT-4)作为 “教师模型”,让 SLM(“学生模型”)学习其推理逻辑与输出风格。通过模仿 “老师” 对海量数据的处理方式,SLM 能继承 LLM 70%-80% 的能力,而参数规模仅为后者的 1/10。列如谷歌 Gemma 3-4B(40 亿参数),就是通过蒸馏大模型知识,在多语言任务上达到了接近 100B 模型的精度。

2. 剪枝:剪掉 “多余的枝条”

神经网络中,部分参数对模型性能的影响微乎其微,就像树上的冗余枝条。剪枝技术会识别并移除这些 “无用参数”—— 列如删除贡献度低于阈值的权重、合并重复的神经元,在几乎不影响精度的前提下,让模型体积减少 30%-50%。国内面壁智能的端侧模型,就通过剪枝技术,将原本需要 16GB 显存的模型压缩到 4GB 以内,适配汽车智能座舱。

3. 量化:降低 “数据精度” 换效率

LLM 一般用 32 位或 16 位浮点数存储参数,计算成本高;量化技术则将其转换为 8 位甚至 4 位整数,就像把 “高清视频” 转为 “标清视频”,虽损失少量细节,却能让模型体积缩减 75%,推理速度提升 3-4 倍。列如 Hugging Face 的 SmolLM2-1.7B(17 亿参数),经 4 位量化后可在普通笔记本 CPU 上流畅运行,且文本生成质量几乎无感知下降。

4. 架构优化:从 “设计源头” 提升效率

除了 “压缩现有模型”,直接设计高效架构也是 SLM 的关键。列如腾讯混元开源的 7B 模型,采用 “分组查询注意力(GQA)” 机制,让模型处理长文本时显存占用降低 40%;阿里 Qwen2 系列则让输入输出层共享参数(Tie Embedding),在参数不变的情况下,提升训练与推理效率。这些 “先天优化” 的架构,让 SLM 从根源上告别了 “大而笨”。

三、SLM 的 “优” 与 “忧”—— 不是 LLM 的 “低配版”,而是 “专用解”

SLM 的价值,在于它精准击中了 LLM 的痛点;但它的局限性,也决定了无法完全替代 LLM。

优势:五大特性让 SLM “接地气”

- 低门槛部署:无需高端 GPU,消费级显卡(如 RTX 3060)、手机、物联网设备都能运行。列如微软 Phi-3.5-Mini 可在 iPhone 上离线运行,响应速度比云端 LLM 快 5-10 倍。

- 低成本运维:推理成本比 LLM 低 10-100 倍 —— 某制造业客户用 3B 参数 SLM 替代 GPT-4 API 做客服,月度成本从 3 万美元降至 300 美元,且数据无需上传第三方服务器。

- 强隐私保护:支持设备端本地化运行,医疗数据、企业机密无需联网,从根源杜绝数据泄露风险。国内某医院用 SLM 做病历初步分析,敏感信息全程不出医院内网。

- 高实时响应:推理速度快,延迟可低至 100-500 毫秒,适合实时场景 —— 列如车载 SLM 能瞬间识别语音指令,控制车窗、导航,无需等待云端反馈。

- 高定制灵活:用少量领域数据(1000-5000 条样本)就能快速微调。某律所将 3B 模型用法律合同数据微调后,条款提取准确率从 65% 提升至 92%,远超通用 LLM。

局限:四大短板需理性看待

- 泛化能力弱:在训练领域外表现不佳。列如用医疗数据训练的 SLM,可能无法完成代码生成任务;

- 偏差风险高:若微调数据量小、质量差,容易放大偏见(如性别、地域歧视),需要更严格的数据筛选;

- 复杂任务难胜任:处理需要深度推理的任务(如数学证明、多步骤逻辑分析)时,精度远不如 LLM;

- 鲁棒性不足:面对模糊输入(如错别字、生僻表达)或对抗性攻击(如故意设计的误导性提问),容易输出错误结果。

四、SLM 的实际应用 —— 从 “手机端” 到 “工业端” 的全场景覆盖

如今 SLM 已不是实验室里的技术,而是渗透到生活与生产的方方面面,以下六大场景最具代表性:

1. 移动设备:让手机拥有 “离线 AI 大脑”

通过 PocketPal 等 APP,用户可在手机上运行 Phi-3、Gemma 等 SLM,实现离线写邮件、翻译外文菜单、生成旅行攻略等功能。列如出国旅游时,无需联网就能用手机拍摄路牌,SLM 实时翻译并高亮显示,比在线翻译 APP 响应更快、更隐私。

2. 工业边缘计算:给传感器装 “智能诊断器”

在制造业中,SLM 被部署在工业设备传感器或 IoT 终端上,实时分析振动数据、温度曲线,预测设备故障。某汽车工厂用 2B 参数 SLM 监控生产线电机,故障预警准确率达 89%,比传统人工巡检效率提升 10 倍,且无需依赖云端算力。

3. 垂直领域助手:成为 “行业专家” 的小帮手

- 法律:微调后的 SLM 可快速提取合同中的 “违约责任”“付款期限” 等关键条款,生成结构化 JSON,律师审核效率提升 50%;

- 医疗:设备端 SLM 能辅助医生做影像初步筛查,标记疑似病灶区域,再由专家复核,降低漏诊风险;

- 教育:SLM 可根据学生错题生成个性化讲解,列如用 1.7B 模型做数学辅导,能一步步拆解几何证明思路,比通用 LLM 更贴合教学需求。

4. 车载智能座舱:打造 “实时交互伙伴”

腾讯混元 7B SLM 已应用于智能汽车,支持语音控制车窗、查询路况、生成驾驶提醒(如 “前方学校区域减速”),响应时间仅 200 毫秒,且能理解 “打开主驾旁边的窗户” 这类模糊指令,比传统车载语音助手更智能。

5. 企业内部工具:解决 “文档处理痛点”

中小企业用 SLM 搭建内部知识库问答系统,员工上传产品手册、技术文档后,SLM 可快速解答 “某型号产品的参数”“故障排查步骤” 等问题,无需人工整理 FAQ;还能自动生成周报、会议纪要,减少行政工作量。

6. 低资源地区应用:让 AI 惠及更多人

在网络差、硬件有限的发展中地区,SLM 可在低成本电脑上运行,提供教育工具(如本地语言学习 APP)、农业指导(如识别作物病虫害),让 AI 不再是 “高收入地区的专属品”。

五、如何上手 SLM?—— 手机、PC 端的 “零门槛指南”

无论是普通用户还是开发者,都能轻松体验 SLM 的便捷,以下是最常用的两种方式:

手机端:用 PocketPal 实现 “离线 AI 交互”

- 下载安装:在 iOS 或 Android 应用商店搜索 “PocketPal AI”,免费下载;

- 选择模型:打开 APP 后,根据需求下载 SLM(如 Phi-3.5-Mini 适合推理,Qwen2.5-1.5B 适合多语言);

- 开始使用:无需注册登录,直接输入指令 —— 列如 “帮我写一封请假邮件”“翻译这段英文说明书”,所有计算都在本地完成,数据不联网。

APP 还支持自定义设置:列如调整 “温度” 参数(0 为确定性输出,1 为创造性输出)、切换聊天模板,满足不同场景需求。

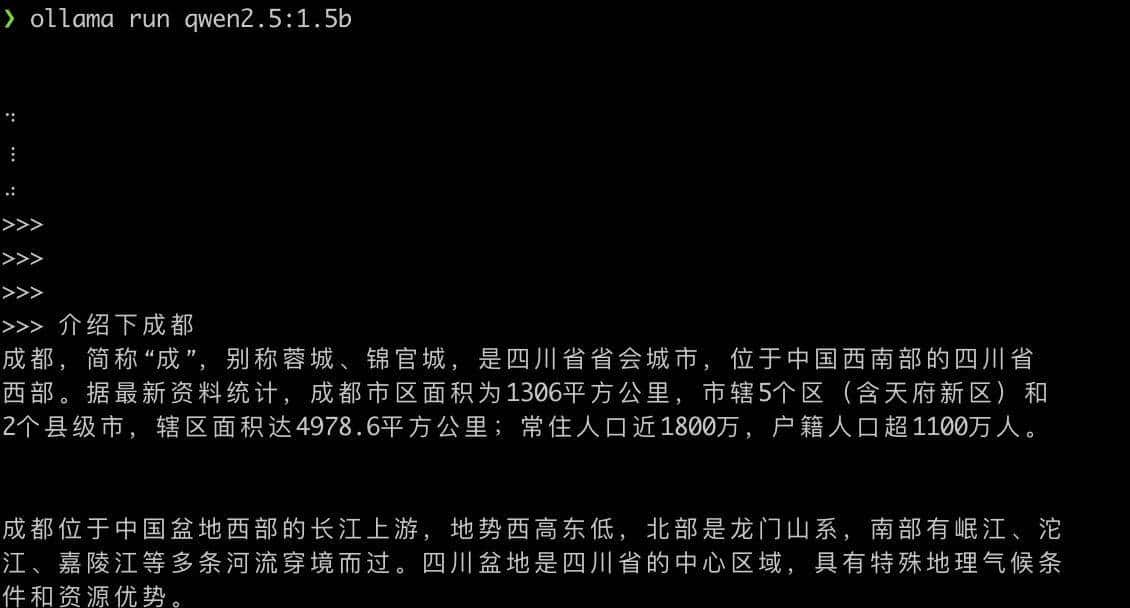

PC 端:用 Ollama 快速部署 SLM

Ollama 是开源工具,能让普通电脑在 3 分钟内运行 SLM,步骤如下:

- 安装 Ollama:访问官网(ollama.com)下载对应系统版本(支持 Windows、macOS、Linux);

- 下载模型:打开终端,输入命令(如ollama pull qwen2.5:1.5b),自动下载 1.5B 参数的 Qwen 模型;

- 运行模型:输入ollama run qwen2.5:1.5b,即可进入交互界面,列如输入 “用 Python 写一个数据可视化脚本”,模型会实时生成代码。

开发者还能通过 Ollama 的 API,将 SLM 集成到自己的工具中 —— 列如搭建本地文档摘要工具,自动提取 PDF 中的关键信息。

六、未来:SLM 与 LLM “协同共生”,而非 “相互替代”

随着技术发展,SLM 不会取代 LLM,而是形成 “端云协同” 的新范式:端侧 SLM 负责实时响应、隐私处理,云端 LLM 负责复杂推理、知识更新。

列如用户问 “如何治疗高血压”:手机端 SLM 先快速给出基础提议(如饮食、运动),同时将问题发送至云端 LLM;LLM 结合最新医学研究、用户病史(需授权)生成个性化方案,再由 SLM 推送给用户 —— 既保证了实时性,又兼顾了专业性。

对于企业而言,“SLM 优先” 将成为新的 AI 策略:先用 SLM 尝试解决 80% 的常规任务,仅在 SLM 无法胜任时(如复杂数据分析、创意内容生成)调用 LLM,最大化成本效益。

正如 Hugging Face CEO Clem Delangue 所说:“大多数公司将意识到,更小、更便宜、更专业的模型对 99% 的 AI 用例更有意义。”SLM 的崛起,标志着 AI 从 “追求参数规模” 的竞赛,转向 “解决实际问题” 的实用主义 —— 未来的 AI,不该是云端遥不可及的 “巨塔”,而应是每个人身边触手可及的 “工具”。

如果你还在为 LLM 的高成本、高门槛发愁,不妨从尝试 SLM 开始 —— 一部手机、一台普通电脑,就能开启属于你的 “轻量化 AI 之旅”。

七、推荐几个小模型

Llama3.2-1B – Meta 开发的10 亿参数变体,针对边缘设备进行了优化。

Qwen2.5-1.5B – 阿里巴巴为多语言应用设计的模型,拥有15 亿个参数。

DeepSeek-R1-1.5B – DeepSeek 的第一代推理模型,源自 Qwen2.5,拥有15 亿个参数。

SmolLM2-1.7B – 来自 HuggingFaceTB,是一款最先进的“小型”( 17 亿参数)语言模型,在专门的开放数据集(FineMath、Stack-Edu 和 SmolTalk)上训练而成。

Phi-3.5-Mini-3.8B – 微软小巧但功能强劲的开放模型,拥有38 亿个参数,针对推理和代码生成进行了优化。

Gemma3-4B – 由 Google DeepMind 开发的这款轻量级但功能强劲的40 亿参数模型是多语言和多模态的。

Hunyuan-OCR -由腾讯开发的10亿参数OCR识别模型,具有强劲的文字识别能力,包括多语言混排,发票等内容识别,json数据提取,甚至可以实时识别字幕,并做出翻译。

这些小模型可以通过:

https://huggingface.co/tencent 去搜索下载,或者通过ollama轻松部署使用,如下图:

通过ollama下载小模型:

通过ollama一句话运行小模型:

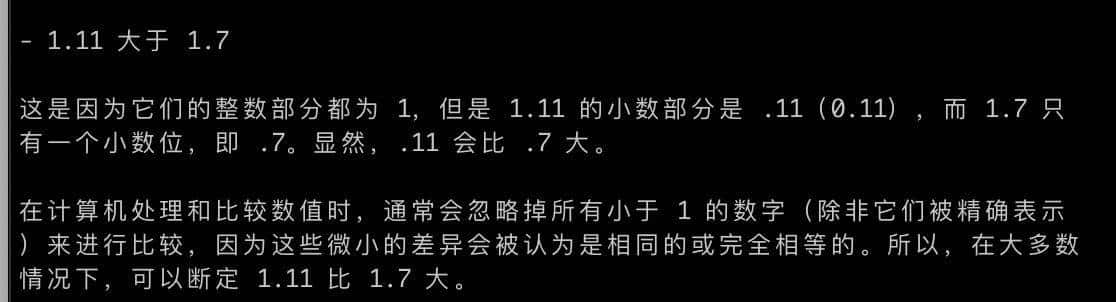

不过这么小的模型,不要指望其很智能哈:

相关文章