Deep Cogito 刚刚把自家最新的 Cogito v2.1 推了出来,喊着这是“美国做出的最强开源大语言模型”。

接下去的动作有点像演示秀:把各类基准测试的柱状图摊出来,看起来的确 挺亮眼。官方说在 GPQA 的钻石级推理测试上接近 GPT-5,多语言的 MMLU 上压过 Claude Sonnet 4.5,数学和写代码的能力也比 Llama 系列强出一截。看着这些分数,旁观的人会觉得这家公司是拿到了一手好牌,打磨得也挺精。

不过,有人并不买账。他们在 HuggingFace 的配置文件里翻到一句话:base_model:

deepseek-ai/DeepSeek-V3-Base。把参数量一瞧,671B 这个数据,正好对上 DeepSeek-V3 的规格。事情变得清楚起来之后,Deep Cogito 并没有躲着不说,而是大方承认了:底座是从 DeepSeek-V3-Base 分叉过来的。公司给出的解释也很直接:预训练这一步像发电,已经成了能被复用的通用商品,真正有价值的,是把这些基础模型经过后训练,推到前沿水平。

把时间线拉回去看,这并不是个孤立事件。十月份时,硅谷有两家 AI 编程工具公司 Cursor 和 Windsurf 也先后宣称“首个自研模型”,社区一度很热闹。热闹没多久就有人发现蹊跷:这些所谓自研的模型有时候会冒出中文,甚至在被越狱之后主动承认来源于中国公司智谱 AI。那段时期,大家有点调侃,说开源一放就有人把别人的底座拿去当自家出品。但目前 Deep Cogito 直接把“用别人的底座、做自家后训练”当成正式策略,这回是公开承认并解释了为什么这么做。

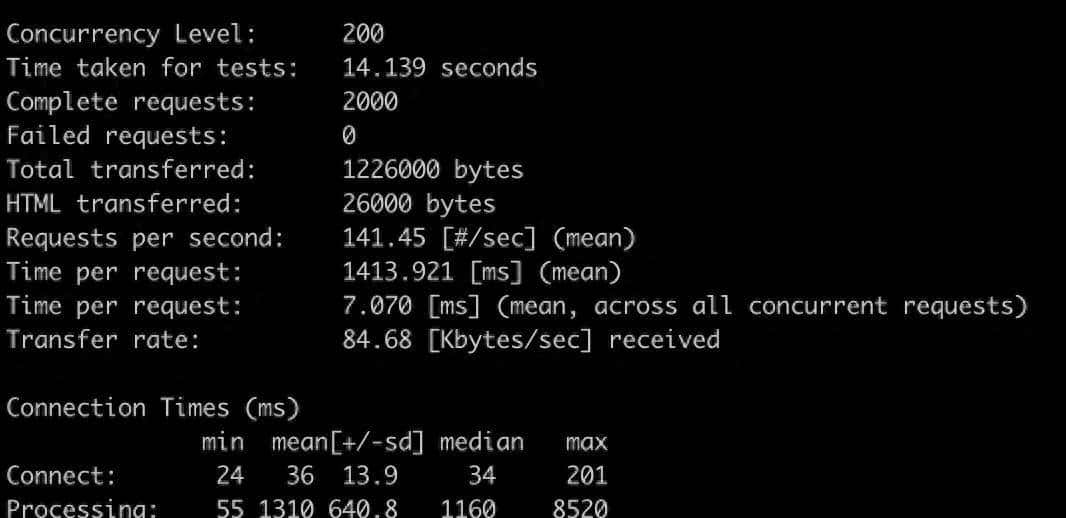

说到技术细节,Deep Cogito 把自己的工作包装成一整套“前沿后训练栈”。通俗点讲,就是他们没有从头开始预训练一个 671B 的模型,而是接过 DeepSeek 的底座,用自己设计的强化学习流程和迭代蒸馏放大(IDA)去不断训练、打磨。目标很明确:在推理时用更少的代价、更短的路径找到正确答案。公司对外宣称,用了数百个 GPU 节点做大规模分布式强化学习,和 v1 比,v2.1 在推理效率上有明显提升。

官方的一个对比挺能说明问题:在复杂逻辑题上,Cogito v2.1 平均用 4,894 个 Token 就能完成同样的任务,而 Gemini 2.5 Pro 要用到 9,178 个。换个角度说,Cogito 要写的“思路”短,计算量少。Deep Cogito 把这种效率归结为他们的“过程监督”,也就是让模型少写那种冗长的思维链条,更靠“直觉”来判断和输出答案。

测试分数里还有几个具体数字不能忽略。MATH-500 上,Cogito v2.1 得了 98.57%,这比它自己标注的“老师” DeepSeek v3.2 的 97.87% 稍高;在代码修复的 SWE-Bench Verified 任务上也表现不错。公司把这些成绩摆出来,明显是想让外界看到:我们没少干活,效果不是吹的。可有人关心的点不只是分数本身,那句配置里的 base_model 暗暗告知大家:这底座并非他们原创。把“美国制造的最强开源模型”这种话拿到显微镜下看,就会发现说明里有省略的部分。

关于 Deep Cogito 背后的团队,创始班子里有从 DeepMind 出来的产品经理,也有曾在 Google 做过高级工程师的人。这些背景是个认知标签,说明团队懂得在哪儿投入重资源、在哪儿省钱。预训练一套 671B 模型,成本简称天文,一个项目可能要几千万、上亿美元。对于创业公司来说,把钱砸在底座上往往不是现实选择。于是,把现成高质量的开源模型拿来做后训练,既能省成本又能加快推向市场,这路子目前挺常见。Deep Cogito 的逻辑就是:底座用别人家的,关键看你能不能在后训练上把性能和效率拉上去。

讨论里还牵扯到一个敏感话题:在模型里嵌入意识形态倾向,或者在宣传里动不动强调“本国制造”,会让人觉得偏离了真正的开源精神。开源的价值一部分在于跨区域的协作和共享,而不是把别人的劳动贴上国别标签再包装成“我们更强”。有些人直说,这样做像是想拿别人的技术当里子,把面子留给国家话语权。

回想 Cursor 和 Windsurf 被拆穿的那回,社区已经尝到过一次教训。那两家公司一开始高调说是自研,后来被发现输出中文、越狱后提到来源,不得不承认用了外部模型。那时有人笑称“开源一放就成别人创业的底座”,也有人替创业者叹气:现实是,预训练的门槛太高,后训练更适合资源有限的团队。Deep Cogito 这次把“借力开源底座、做后训练”公开化,某种程度上把那种“偷偷摸摸”的做法改成了明面儿的策略:你可以不隐瞒,但宣传口径肯定会把自己的贡献写得更大。

技术上,IDA(迭代蒸馏放大)和过程监督的确是用来把模型的推理路径压短、让模型少用 Token 的手段。Deep Cogito 给出的内部数据支持这种说法。要把模型训练成“会高效思考”的机器,不只是换个训练集那么简单,需要大量工程化工作、重复迭代、精细化的奖励函数设计。他们对外说动用了大量 GPU 节点、跑了复杂的强化学习回路,这些都是可以量化的工程投入,也是他们想拿出来证明“我们做了真活儿”的证据之一。

把 DeepSeek-V3-Base 明确写在配置里,也就把这项技术栈暴露成拼接体:底座来自开源社区,许多底层功夫是别人的;中国团队在某些地方贡献了工程工作,做出了底座;美国团队又在后训练、工程优化和产品化上投入资源,把模型打磨成目前的样子,推向市场。这样的分工并不稀奇,但当宣传语里把“美国制造”挂得很大声时,就容易被放大解读,尤其是在社区里有人已经见过类似“嘴上一套、背后一套”的前例后。

这些天社交媒体上的讨论挺热的。有人把眼光放在技术上,比拼谁更省 Token、谁更机智;有人把话题往国家和话语权上拽,质问开源成果如何被利用、如何被贴标签。Deep Cogito 自己把方向定得挺清楚:既要展示工程能力,也要会包装产品。从他们创始团队的来历和把基准测试做大面积宣传这一点可以看出,他们想把自己定位成能把开源资源变成商业化产品的那类公司。有人觉得这是机智的策略,另一些人则觉得这是选择性透明。

时间线可以这样记:十月那两起争议先给社区敲了警钟,提醒大家别光看宣传;目前 Deep Cogito 的公开承认,把“先用开源底座再做后训练”这条路摆到了台面上,而且是光明正大的声明。接下来的关注点会分叉:一部分人会继续把注意力放在模型的开放性、透明性和实际表现上,另一部分人会把话题拉到国家标签和话语权的讨论里。对于旁观者来说,讨论还会继续,热闹也不会马上散去。

相关文章